Autenticaci´

on Biom´

etrica de Personas

por medio del Reconocimiento del Iris

Tesis que presentan

Paulina Alejandra Baldo Romero

Josu´

e Garc´ıa Molina

Para Obtener el T´ıtulo de

Ingeniero en Comunicaciones y Electr´

onica

En la Especialidad de

Computaci´

on

Director de la Tesis:

M. en C. Francisco L´opez Orozco.

Resumen

Hoy en d´ıa, es de gran importancia el control de acceso a recursos o lugares,

restringiendo a quienes no superen dicho control. La autenticaci´on de personas busca

identificar usuarios de forma un´ıvoca. Se usan tres principios para autenticar usuarios:

prueba de que uno posee algo, como los certificados digitales, prueba de que uno sabe

algo, como las contrase˜nas y prueba de que uno es algo. La autenticaci´on biom´etrica

estudia c´omo hacer posible la autenticaci´on bas´andose en el tercer principio.

Este trabajo presenta el desarrollo de una aplicaci´on de software libre

(implemen-tada en plataformas dre libre distribuci´on) y de dominio p´ublico para la autenticaci´on

biom´etrica de personas basada en el reconocimiento de iris. Con ´el se verifica la

uni-cidad del patr´on de iris del ojo as´ı como su confiabilidad para usarse como t´ecnica

de autenticaci´on biom´etrica. A pesar de que existen hoy en d´ıa varios sistemas de

reconocimiento del iris de tipo comercial, la gran mayor´ıa usa los algoritmos

paten-tados. Para evaluar el rendimiento de los algoritmos implementados se hizo uso de

una base de datos de im´agenes tomadas del iris de alrededor de 108 personas (756

im´agenes). Se presentan los resultados m´as importantes que verifican el rendimiento

de la aplicaci´on.

Palabras clave: Autenticaci´on, biometr´ıa, reconocimiento de patrones,

patr´on de iris.

studies how to do the authentication possible being based on the third principle.

This work presents the development of a free software application for the

bio-metrics authentication of people based on iris pattern recognition. With this work,

it verifies the unicity of the iris pattern by using as biometrics authentication.

Al-though, there are been development several iris recognition systems, the majority of

them are based on patented algorithms. In order to evaluate the performance of the

implemented algorithms we used a database iris image which contains 756 iris images

from 108 subjects approximately. This work presents the most important results of

all tests done.

Keywords: Authentication, biometrics, pattern recognition, iris pattern.

Agradecimientos

Queremos agradecer a nuestros padres y hermanos por todo el apoyo y la confianza

que depositaron en nosotros en cada uno de los momentos empleados para realizar

este trabajo, por ayudarnos y ense˜narnos a corregir nuestros errores.

Gracias a los profesores que han contribuido a nuestro desarrollo personal y

acad´emico durante toda nuestra carrera y que nos apoyaron o nos dieron consejos

para hacer este proyecto. En especial, al M. en C. Francisco L´opez Orozco y al M. en

C. Roberto Galicia Galicia que fueron nuestros asesores.

Finalmente, agradecemos el apoyo recibido por parte de la Academia de

Com-putaci´on del Departamento de Ingenier´ıa en Comunicaciones y Electr´onica de la

Es-cuela Superior de Ingenier´ıa Mec´anica y El´ectrica Unidad Zacatenco del Instituto

Polit´ecnico Nacional, para la realizaci´on de este trabajo, en especial de la Presidenta

de la Academia Ing. Miriam Cu´ellar Mercado por la confianza depositada en nosotros.

1.5. Organizaci´on de la Tesis . . . 11

2. Autenticaci´on Biom´etrica 12 2.1. M´etodos de Autenticaci´on Biom´etrica . . . 12

2.1.1. Caracter´ısticas de los Sistemas Biom´etricos . . . 12

2.2. Reconocimiento basado en el Iris . . . 13

2.2.1. Historia . . . 13

2.2.2. Comercializaci´on . . . 14

2.2.3. Caracter´ısticas del Iris . . . 14

2.3. Etapas del Reconocimiento . . . 16

2.3.1. Adquisici´on . . . 16

2.3.2. Procesamiento Digital de Im´agenes . . . 17

2.3.3. Pre-procesamiento . . . 18

2.3.4. Segmentaci´on . . . 24

2.3.5. Transformada Hough . . . 27

2.3.6. Extracci´on de caracter´ısticas y/o firma del iris . . . 28

2.4. M´etricas para evaluar la similaridad entre dos patrones . . . 28

2.4.1. Distancias de Hamming . . . 28

2.4.2. Distancia Euclideana Ponderada . . . 29

2.4.3. Correlaci´on Normalizada . . . 29

3. Implementaci´on del Mecanismo de Autenticaci´on 31 3.1. Adquisici´on de las im´agenes . . . 31

3.2. Segmentaci´on . . . 32

3.2.1. Operador de Canny . . . 32

3.2.2. Correcci´on gamma . . . 40

3.2.3. Supresi´on de no m´aximos . . . 42

3.2.4. Umbralizaci´on por medio de hist´eresis . . . 45

3.2.5. Transformada de Hough . . . 48

3.3. Obtenci´on de la firma del iris . . . 55

3.4. Reconocimiento . . . 63

4. Desarrollo de la Interfaz Gr´afica 68 5. Evaluaci´on y An´alisis de Resultados 72 5.1. Evaluaci´on del mecanismo de autenticaci´on . . . 72

6. Conclusiones y Trabajo a Futuro 81 A. Anexo 83 A.1. Diagrama de clases para el mecanismo de autenticaci´on . . . 83

B. Bibliograf´ıa 87

2.4. Histograma de una imagen de Casia. . . 21

2.5. Histograma estirado de una imagen de Casia. . . 21

2.6. Proceso de ecualizaci´on del histograma. . . 22

2.7. Histograma de una imagen de Casia. . . 23

2.8. Histograma ecualizado de una imagen de Casia. . . 23

2.9. Proceso de convoluci´on. . . 24

3.1. Diagrama de la clase implementada del algoritmo de Canny. . . 33

3.2. Gr´afica que muestra el comportamiento del filtro gaussiano . . . 35

3.3. Diagrama de la clase del Filtrado Gaussiano . . . 36

3.4. Imagen de ejemplo de la base de datos CASIA V1.0. . . 38

3.5. Imagen gradiente obtenida a partir de la figura 3.4. . . 38

3.6. Imagen orientaci´on obtenida a partir de la figura 3.4. . . 39

3.7. Diagrama de la clase que calcula la matriz gradiente y la matriz ori-entaci´on. . . 39

3.8. Imagen una vez suprimidos sus No m´aximos, proveniente de la imagen 3.4. . . 42

3.9. Diagrama de la clase para el algoritmo de Supresi´on de No M´aximos 3.4. 43 3.10. Imagen una vez umbralada por hist´eresis proveniente de la imagen 3.4. 46 3.11. Esquema de la clase que implementa la Umbralizaci´on por Hist´eresis 3.4. 47 3.12. Imagen que muestra el resultado parcial de la transformaci´on Hough en la b´usqueda de la circunferencia iris/esclera. . . 49

3.13. Figura que ejemplifica el funcionamiento de la transformada de Hough. 50 3.14. a. Clase del mecanismo de la Transformada de Hough. . . 51

3.15. b. Clase del mecanismo de la Transformada de Hough. . . 52

3.16. Imagen que muestra la m´ascara utilizada para extraer la circunferencia interior (iris/pupila) de la imagen de entrada original. . . 55

3.17. Imagen que muestra la m´ascara utilizada para extraer la circunferencia exterior (iris/esclera) de la imagen de entrada original. . . 56

3.18. Imagen que muestra la regi´on de iris extra´ıda. . . 56

3.19. Clase que permite extraer la regi´on del iris. . . 57

3.20. Imagen que muestra la firma del iris extra´ıda. . . 60

3.21. Figura que ejemplifica el proceso de extracci´on del iris. . . 61

3.22. Figura que ejemplifica el proceso de extracci´on del iris. . . 61

3.23. Diagrama que muestra la clase que realiza la firma normalizada del iris. 62 3.24. Esquema de la clase que implementa las distancias de Hamming. . . . 65

4.1. Acceso al Mecanismo de Reconocimiento de Iris. . . 69

4.2. Mecanismo de Reconocimiento de Iris. . . 69

4.3. Usuario no autenticado. . . 70

4.4. Salidas de las etapas del mecanismo de reconocimiento. . . 71

5.1. Filtrado Gaussiano con m´ascara de 5x5 . . . 73

5.2. Imagen Umbralizada contalto = 0.20 y tbajo = 0.19 que no proporciona informaci´on suficiente. . . 73

5.3. Imagen Umbralizada con talto = 0.13 y tbajo = 0.10 que proporciona informaci´on suficiente. . . 74

5.4. Extracci´on del iris considerando las circunferencias conc´entricas. . . . 74

5.5. Extracci´on del iris considerando las circunferencias con centros y radios independientes. . . 75

5.6. Nomeclatura utilizada como identificador para la firma de iris de cada sujeto. . . 75

5.7. Gr´afica de firmas de iris de las mismas entidades. . . 77

5.8. Tabla de aciertos y errores. . . 78

5.9. Grafica del sujeto 4 contra las dem´as entidades. . . 79

5.10. Grafica del sujeto 83 contra las dem´as entidades. . . 80

A.1. Diagrama de clases del mecanismo de autenticaci´on . . . 86

Cap´ıtulo 1

Introducci´

on

En la actualidad es bien conocida la importancia en los niveles de seguridad, principalmente el control del acceso a lugares y a la protecci´on de informaci´on con la finalidad de evitar el mal uso que pudiera d´arsele a los mismos. Este aspecto no ha cambiado a trav´es de la historia, pues hemos visto en distintos acontecimientos que la fuga de informaci´on en manos de las personas incorrectas y el permitir el acceso a lugares a seres malintencionados han sido determinantes en episodios hist´oricos.

A trav´es de las historias de ciencia ficci´on, pudimos conocer ciertos mecanismos que garantizaban la seguridad en los aspectos mencionados, y cre´ımos que s´olo eran parte de una historia fant´astica alejada de nuestra realidad. Sin embargo, ahora est´an m´as cerca de nuestra vida cotidiana de lo que alguna vez imaginamos gracias a las Tecnolog´ıas Biom´etricas.

Debido a los avances recientes en seguridad y a los costos relativamente bajos de las Tecnolog´ıas de Autenticaci´on Biom´etrica, en las cuales encontramos aplicaciones como son el reconocimiento basado en cara, dedos, manos, iris y voz, las cuales se en-cuentran actualmente disponibles comercialmente al representar soluciones atractivas para restringir el acceso a informaci´on, computadoras y redes.

La autenticaci´on de personas, en t´erminos de seguridad, es el proceso por el cual un usuario se identifica de forma un´ıvoca, para lograr el acceso a un recurso restringido. Hoy en d´ıa, existen tres principios para autenticar usuarios: a) Prueba de que uno posee algo, como el caso de los certificados digitales. b) Prueba de que uno sabe o conoce algo, como el caso de contrase˜nas, n´umeros de identificaci´on personal, etc. y c) Prueba de que uno es quien dice ser. La autenticaci´on biom´etrica estudia como hacer posible la autenticaci´on bas´andose en el tercer principio (c).

Por ejemplo, en las referencias [3], [2], [6] se utiliza la imagen normalizada del iris como entrada a una etapa de filtrado de Gabor, es decir, se realiza un filtrado de la imagen en forma bidimensional,donde cada p´ıxel se representa por 2 bits. En [8] la obtenci´on del c´odigo de la regi´on normalizada del iris se obtiene mediante un an´alisis multidimensional empleando Wavelets Gabor.

En el presente trabajo se propone un mecanismo alterno que combina una serie de algoritmos simples, como las distancias de Hamming ponderadas como elemento discriminante en el proceso del reconocimiento del iris de personas diferentes.

1.2.

Planteamiento del Problema

En las ´ultimas d´ecadas ha surgido el tema de reconocer a las personas por medio del iris. Aunque para un individuo com´un no es nada sencillo, gracias al desarrollo tecnol´ogico se ha podido lograr. La particularidad que tiene este ´organo es que no s´olo es ´unico para cada individuo, sino que tiene una forma similar para todos los individuos.

La problem´atica constante del robo de informaci´on o pertenencias personales, inclusive de dep´ositos de cuentas bancarias; as´ı como tambi´en personas con pasaportes falsos o que intentan ingresar a computadora que no les corresponden ha hecho que surja la Autenticaci´on mediante la biometr´ıa la cual es infinitamente m´as confiable que una firma, un nip (n´umero de identificaci´on personal) o contrase˜na.

1.3.

Objetivos

Objetivo General

1.4 Metodolog´ıa 9

Objetivos Particulares:

Desarrollar un m´odulo de software libre para la autenticaci´on biom´etrica de personas por medio del reconocimiento del iris.

Hacer uso de t´ecnicas avanzadas de procesamiento digital de im´agenes con la finalidad de proveer de cierta robustez a los algoritmos implementados.

Desarrollar una aplicaci´on completa escrita en el lenguaje de programaci´on JAVA que haga uso del m´odulo de autenticaci´on biom´etrica propuesto, con su correspondiente interfaz gr´afica de usuario.

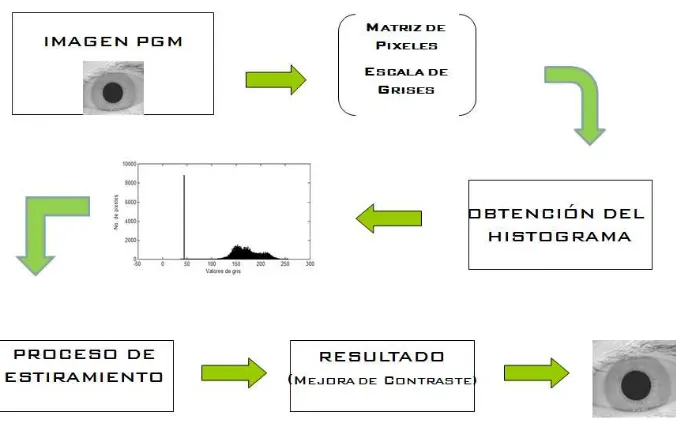

[image:12.612.151.475.258.575.2]En la figura 1.1 se presenta el diagrama a bloques general del m´odulo de autenticaci´on que se pretende implementar.

Figura 1.1: Esquema general del m´odulo de autenticaci´on.

1.4.

Metodolog´ıa

por el Center for Biometrics and Security Research del Institute of Automation Chinese Academy of Sciences en Beijing, China, aunque las primeras pruebas se realizaron con la Base de Datos Irisbath proporcionada por el Grupo de Procesamiento de Se˜nales e Im´agenes (SIPG) del Departamento de Ingenier´ıa El´ectrica y Electr´onica de la Universidad de Bath en Inglaterra.

Debido a que se propone un mecanismo eficaz que realice la autenticaci´on de personas a trav´es de im´agenes tomadas de su iris utilizando t´ecnicas avanzadas de procesamiento digital de im´agenes y estructuras de programaci´on, se ha de-sarrollado un m´odulo de software libre que ha sido codificado en plataformas de libre distribuci´on, como es el caso del Sistema Operativo Linux en su distribu-ci´on Ubuntu 7.04, el lenguaje de programadistribu-ci´on JAVA (J2SE v5.0), y el gestor de bases de datos MySQL v5. Por esto, todas las implementaciones hechas pueden ser descargadas, estudiadas, modificadas y mejoradas para ser incorporadas a otro tipo de aplicaciones.

Sobre las im´agenes mencionadas se realizaron todas las pruebas necesarias para los m´odulos de pre-procesamiento y segmentaci´on; para el pre-procesamiento se probaron varias t´ecnicas como ecualizaci´on y el estiramiento del histograma; por la parte de la segmentaci´on se utilizaron las m´ascaras de Sobel, de Prewitt, el Laplaciano y el operador de Canny, as´ı como la Transformada de Hough para los bordes circulares.

1.5 Organizaci´on de la Tesis 11

1.5.

Organizaci´

on de la Tesis

El cap´ıtulo 2 presenta en forma detallada los principios te´oricos matem´aticos en que se basan los sistemas de reconocimiento del patr´on del iris; adem´as se mues-tra c´omo han sido desarrollados e implementados en forma general los sistemas de autenticac´on biom´etrica.

En el cap´ıtulo 3, se explica de manera detallada el dise˜no algor´ıtmico del m´odulo de software implementado para llevar a cabo la autenticaci´on de personas mediante el reconocimiento del patr´on del iris.

El cap´ıtulo 4, presenta una aplicaci´on ejemplo completa y su correspondiente interfaz gr´afica de usuario, que muestra el uso del m´odulo de software desarrollado previamente. Los resultados obtenidos con las pruebas a las que fueron sometidas las implementaciones realizadas as´ı como el an´alisis de dichos resultados son presentados en el cap´ıtulo 5.

comprobar la veracidad de cierta informaci´on y a´un en la actualidad se utiliza para los mismos fines, aunque ha sido desplazado por r´ubricas o firmas de tipo gr´aficas.

El t´ermino biometr´ıa, se refiere a la identificaci´on autom´atica, o a la verificaci´on de la identidad, de individuos usando una caracter´ıstica fisiol´ogica, o del compor-tamiento. Ejemplos de caracter´ısticas fisiol´ogicas incluyen im´agenes de la mano o de los dedos. Las caracter´ısticas de conducta son rasgos que son aprendidos o adquiridos; por ejemplo, la verificaci´on de la din´amica de la firma o la verificaci´on de la voz.

El reconocimiento biom´etrico puede ser usado para la identificaci´on, donde el sistema identifica una persona de un grupo a trav´es de la b´usqueda en una base de datos. Un sistema tambi´en puede ser usado para la verificaci´on, en el cual, el sistema biom´etrico autentifica la identidad que una persona dice tener. Este ´ultimo caso es el del presente trabajo.

2.1.1.

Caracter´ısticas de los Sistemas Biom´

etricos

Un sistema biom´etrico requiere que la caracter´ıstica biom´etrica en que est´a basada satisfaga los siguientes requisitos:

Universalidad:Toda persona debe poseer dicha caracter´ıstica.

Unicidad:Dos personas se deben diferenciar seg´un dicha caracter´ıstica biom´etri-ca.

2.2 Reconocimiento basado en el Iris 13

Permanencia:La caracter´ıstica debe ser lo suficientemente invariable trat´andose de la misma persona.

Cuantificaci´on: La caracter´ıstica debe ser mesurable.

En la pr´actica, un buen sistema biom´etrico debe adem´as considerar:

Funcionamiento:Efectividad y velocidad del sistema.

Aceptabilidad: Grado al que la gente est´a dispuesta a aceptar el uso de una caracter´ıstica biom´etrica en su vida diaria; por esta raz´on debe resultar inofen-sivo.

Robustez: Dificultad para enga˜nar al sistema usando m´etodos fraudulentos.

Los sistemas biom´etricos est´an constituidos de m´odulos de hardware y software; el hardware se utiliza principalmente para la captura o toma de la caracter´ıstica saliente del ser humano, y el software para interpretar los datos que resultan del proceso anterior y determinar la aceptabilidad o su rechazo. En el presente proyecto nos centramos ´unicamente en el desarrollo del m´odulo de software, ya que se utiliz´o una base de datos de im´agenes de iris para probar el desarrollo.

El ´exito de un sistema biom´etrico se mide seg´un diferentes criterios y cada tec-nolog´ıa presenta ventajas y desventajas. Uno de los criterios m´as importantes para evaluar el ´exito de una aplicaci´on se refiere a la exactitud del sistema. El nivel de la exactitud en un sistema biom´etrico implica la tasa de falsa-aceptaci´on y la tasa de falso-rechazo. La tasa de falsa-aceptaci´on es el porcentaje de usuarios que son auten-ticados erron´eamente y los segundos representan, usuarios aut´enticos que han sido rechazados (no reconocidos).

2.2.

Reconocimiento basado en el Iris

2.2.1.

Historia

2.2.2.

Comercializaci´

on

El reconocimiento biom´etrico de personas constituye un campo espec´ıfico dentro de las ´areas de procesamiento de se˜nales y de reconocimiento de patrones, en el que se han realizado enormes avances y aportaciones cient´ıficas y tecnol´ogicas en la ´ultima d´ecada. Esto ha conducido a que diversos organismos tecnol´ogicos internacionales, entre los que destaca el NIST (Nacional Institute of Standards and Technology), hayan considerado que las tecnolog´ıas de reconocimiento biom´etrico est´an suficientemente maduras para ser aplicadas a soluciones comerciales.

Flom, Safir y Daugman, fundaron IriScan Corp., empresa que tendr´ıa en su poder la patente y que se encargar´ıa de licenciarla a otras compa˜n´ıas, tales como integradores de sistemas y desarrolladores que quieran explotar productos de reconocimiento basa-dos en iris. A partir de ah´ı, la evoluci´on ha venido marcada por los progresos de basa-dos empresas, la propia IriScan, as´ı como Sensar Corp., la cual lanz´o al mercado una c´amara especial para adquirir las im´agenes de iris en los cajeros autom´aticos. Uno de los sistemas de reconocimiento de iris comerciales m´as exitosos es distribuido por Iridian Technologies el cual utiliza algoritmos patentados desarrollados por Daugman. Por lo general, los fabricantes de los sistemas biom´etricos actuales mencionan en las descripciones de sus productos las tasas de Falsa-Aceptaci´on y de Falso-Rechazo para tratar de cuantificar el nivel de exactitud de los mismos.

2.2.3.

Caracter´ısticas del Iris

Es necesario que se revisen algunos conceptos relacionados con la anatom´ıa del ojo humano, ya que dicha constituci´on influye notablemente en la robustez de las t´ecnicas que la utilizan como caracter´ıstica biom´etrica.

Estructura Interna del Ojo Humano

2.2 Reconocimiento basado en el Iris 15

produce cambios normales del color del iris, pero la evidencia cl´ınica disponible indica que el propio modelo del iris es estable a lo largo de toda la vida.

Es un ´organo interior protegido del ojo, detr´as de la c´ornea y el humor acuoso, es visible externamente a una distancia c´omoda puesto que los medios de comunicaci´on ´opticos delante de ´el son transparentes. El iris est´a compuesto de tejido conjuntivo el´astico. Siendo un ´organo interior del ojo, el iris es inmune a influencias medioambi-entales.

En base a esto, se puede concluir que el iris es un tejido pigmentado de alta movilidad y que se encuentra visible desde el exterior, debido a la transparencia de la c´ornea, y gracias a la misma se encuentra perfectamente protegido de agentes externos.

El iris se ve afectado por la pupila cuando ´esta reacciona a la luz. Las deforma-ciones el´asticas que ocurren con la dilataci´on y contracci´on son r´apidamente corregidas empleando algoritmos matem´aticos que se encargan de localizar los bordes interno y externo del iris.

El movimiento pupilar, incluso en la ausencia de cambios en iluminaci´on y las deformaciones el´asticas asociadas que se crean en la textura del iris, proporcionan protecci´on contra el fraude con fotograf´ıas, ojos de vidrio, u otras simulaciones de un iris.

Caracter´ısticas del iris para ser parte de un sistema biom´etrico

Una propiedad que el iris comparte con las huellas dactilares es la morfolog´ıa aleatoria de su estructura, esto quiere decir que la textura del iris es distinta para cada persona. El iris presenta ciertas caracter´ısticas desde su potencial aplicaci´on a la identificaci´on biom´etrica, algunas de ellas son:

La facilidad de registrar su imagen a cierta distancia, sin la necesidad de con-tacto f´ısico.

El alto nivel de aleatoriedad en su estructura y una densidad de informaci´on de 3.4 bits por mm(cuadrado) de tejido.

Estable y sin cambio durante el periodo de vida del sujeto.

Estabilidad frente a cambios originados por accidentes debido a la protecci´on que le brinda la c´ornea.

Para el caso de nuestro proyecto, el empleo del iris en un sistema biom´etrico satisface las caracter´ısticas expuestas en el punto 2.1.1. En relaci´on a la universalidad, el iris es un ´organo interno que se forma durante la gestaci´on. Sobre la unicidad, la textura del iris es muy compleja y presenta gran cantidad de caracter´ısticas distintivas, lo que hace que var´ıe enormemente entre las distintas personas.

Al ser un ´organo interno protegido es dif´ıcil que se da˜ne, por lo tanto tambi´en satisface la permanencia. Para conseguir la cuantificaci´on del iris se debe hacer uso de las t´ecnicas de procesamiento de im´agenes, con la finalidad de extraer la informa-ci´on. Tambi´en resulta un sistema funcional ya que es bastante efectivo, por ejemplo, el m´etodo Daugman alcanza porcentajes de acierto de 100 %; y tambi´en es un sistema r´apido. En relaci´on a la aceptabilidad del sistema, se trata de un sistema no invasi-vo. Como ya se mencion´o, esta t´ecnica presenta tasas de Falso Rechazo muy bajas, manteniendo al mismo tiempo unas tasas de Falsa Aceptaci´on pr´acticamente nulas. Por el contrario, tiene un costo, tanto computacional como econ´omico, relativamente elevado para algunas aplicaciones, como se explicar´a en los siguientes cap´ıtulos.

2.3.

Etapas del Reconocimiento

2.3.1.

Adquisici´

on

En el cap´ıtulo uno se coment´o que las im´agenes que utilizamos para la realizaci´on de este proyecto se obtuvieron de una bases de datos oficial. Un ejemplo de la misma se muestra en la figura 2.1.

2.3 Etapas del Reconocimiento 17

Figura 2.1: Imagen ejemplo de la base de datos empleada CASIA, donde se se˜nalan las partes constitutivas de la misma.

probar´a su robustez con la comprobaci´on de que independientemente del iris usado para la identificaci´on, se proporcionan los resultados esperados.

2.3.2.

Procesamiento Digital de Im´

agenes

En esta secci´on se describen en forma breve algunos conceptos importantes en materia de procesamiento digital de im´agenes ´utiles para el desarrollo del presente trabajo, ya que las im´agenes que se emplearon son de naturaleza totalmente digital.

El t´ermino imagen se refiere a una funci´on bidimensional de intensidad de luz f(x, y), donde x y y denotan las coordenadas espaciales y el valor de f en cualquier punto (x, y) es llamada intensidad o nivel de gris de la imagen en ese punto.

Una imagen digital es una imagenf(x, y) que ha sido discretizada en coordenadas espaciales y en intensidad. Una imagen digital puede considerarse como una matriz cuyos ´ındices del rengl´on y columna identifican un punto en la imagen y el correspon-diente valor del elemento de la matriz identifica el nivel de intensidad de luz en ese punto tal y como se muestra en la ecuaci´on 2.1. Los elementos de tal arreglo digital son llamados elementos de imagen, elementos de pintura o p´ıxeles.

f(x, y) =

f(0,0) f(0,1) · · · f(0, N −1) f(1,0) f(1,1) · · · f(0, N −1)

... ... ... ...

f(M −1,0) f(M −1,2) · · · f(M −1, N −1)

(2.1)

manera se le conoce como imagen en tonos de gris. Una imagen binaria es una imagen monocrom´atica cuantizada a 1 bit por p´ıxel, esto es, dos niveles, blanco o negro.

Como ya se dijo, el valor de f, denotar´a el color, tono o nivel de gris de un elemento de imagen (p´ıxel) en cierta coordenada (x, y). Un tono muy claro (el m´as claro), denotar´a una cantidad de luz alta (tono blanco), mientras que un tono muy obscuro (el menos claro), denotar´a una cantidad de luz baja (tono negro).

2.3.3.

Pre-procesamiento

Por lo general, cuando se va a trabajar con im´agenes se debe realizar una etapa pre-via llamada pre-procesamiento, ya que hay que considerar ciertos factores que podr´ıan afectar directamente en el ´exito o el fracaso de nuestro sistema de reconocimiento.

Por otra parte, el tama˜no del iris generalmente var´ıa en diferentes im´agenes debido a la contracci´on o a la dilataci´on del iris causada por diferentes niveles de iluminaci´on; tambi´en que se pueden tener diferentes distancias entre el ojo y la c´amara, rotaci´on del ojo y otros factores. Debido a todo esto, es necesario aplicar un procesamiento a las im´agenes antes de utilizarlas en las siguientes etapas del proceso. A continuaci´on se presentan algunos m´etodos aplicados al pre-procesamiento de im´agenes.

Estiramiento del Histograma

2.3 Etapas del Reconocimiento 19

Figura 2.2: Histogramas que ejemplifican el problema de contraste en una imagen.

de p´ıxeles que tienen ese valor de gris. Al proceso de extender los valores de los p´ıxeles a lo largo del histograma se le conoce comoestiramiento del histograma.

En la figura 2.2 se muestran las formas de contraste en una imagen, la cual nos muestra el problema que pueden tener las im´agenes originales si no tienen un buen contraste.

La expresi´on empleada en el mecanismo del estiramiento del histograma se muestra en la expresi´on 2.3.

P ixelSalida= (L−1)(P ixelEntrada−N ivelM in)

(N ivelM ax−N ivelM in) (2.3)

Donde: L−1 es el nivel m´aximo permitido de un p´ıxel y determinado por el n´umero de bits por p´ıxel. Lson los niveles de gris. P ixelEntrada es el tono de gris del p´ıxel a modificar. P ixelSalida es el tono de gris del p´ıxel modificado. N ivelM axes el tono m´aximo existente en la imagen de entrada. N ivelM in es el tono m´ınimo existente en la imagen de entrada.

El algoritmo que empleamos para la implementaci´on se muestra en la figura 2.3.

Figura 2.3: Algoritmo para el estiramiento del histograma.

En las im´agenes 2.4 y 2.5 se muestra el histograma de una imagen de la base de datos CASIA y el histograma estirado de la misma imagen con la finalidad de ejemplificar este mecanismo.

Un aumento de contraste no revelar´a informaci´on nueva que no est´e contenida en la imagen. El contraste solamente presentar´a la misma informaci´on existente en los datos originales, pero de una forma m´as clara. Este mejoramiento de contraste va a ayudar a nuestro mecanismo de autenticaci´on a realizar de una manera m´as efectiva los m´odulos de segmentaci´on y de codificaci´on.

Ecualizaci´on.

Este es otro mecanismo de pre-procesamiento que al igual que el anterior va a generar la mejora del contraste de las im´agenes obtenidas de la Base de Datos.

La ecualizaci´on permite adoptar el mismo n´umero de muestras para cada valor de p´ıxel, y esto se logra a trav´es de la obtenci´on del histograma de las im´agenes a analizar. Consiste en encontrar una transformaci´on en la cual el histograma tenga una representaci´on uniforme, es decir, con la ecualizaci´on trataremos de igualar lo m´as posible el histograma de una imagen al histograma ideal.

2.3 Etapas del Reconocimiento 21

Figura 2.4: Histograma de una imagen de Casia.

Figura 2.6: Proceso de ecualizaci´on del histograma.

Es muy frecuente normalizar un histograma dividiendo cada uno de sus valores por el n´umero total de p´ıxeles en la imagen, denotado porn. De tal modo que el histograma nos quedar´ıaP(rk) = nk/n, parak = 0,1, ..., L−1. De esta manera, P(rk) da una estimaci´on de la probabilidad de la ocurrencia del nivel de gris rk. Hay que notar que la suma de todos los componentes de un histograma normalizado es igual a 1.

Para cualquier r que satisfaga las condiciones anteriores, centramos nuestra atenci´on en transformaciones de la forma expresada en la ecuaci´on??.

s =T(r) (2.4)

Esto ocurre si 0 < r < 1 y asumimos que T(r) debe ser monot´onicamente creciente, esto indica que la pendiente de la funci´on no puede ser negativa: f racdsdr >0. Para esto se debe suponer quer y sson continuas y que adem´as r ys son variables aleatorias. P(r) yP(s) son funciones de densidad de proba-bilidad.

El procedimiento de ecualizaci´on del histograma se muestra en la figura 2.6.

Un ejemplo del resultado de la aplicaci´on de la ecualizaci´on del histograma se muestra en las figuras 2.7 y 2.8.

Filtrado Espacial.

2.3 Etapas del Reconocimiento 23

Figura 2.7: Histograma de una imagen de Casia.

ner los valores promedio de la matriz, entre otros resultados. Esta m´ascara se escoge a partir del resultado que deseamos obtener. El proceso de convoluci´on se ejemplifica en la figura 2.9.

Figura 2.9: Proceso de convoluci´on.

2.3.4.

Segmentaci´

on

La segmentaci´on es una etapa imprescindible en diversos procesos de tratamiento de im´agenes y se puede decir que es el proceso que consiste en subdividir o parti-cionar una imagen en sus regiones, componentes, partes u objetos. Tambi´en puede ser definida como el encontrar, por medio de un algoritmo num´erico, sus regiones ho-mog´eneas y sus bordes. La segmentaci´on autom´atica de im´agenes es, en general, una de las tareas m´as dif´ıciles de realizar en el an´alisis de im´agenes debido a que tiene una influencia determinante en el correcto desempe˜no del mecanismo de reconocimiento. [15].

2.3 Etapas del Reconocimiento 25

momento de obtener la imagen del objeto y al ser detectables implica que debe existir al menos un algoritmo para su localizaci´on, ya que de otra manera dichos ´ındices visuales no ser´ıan ´utiles.

Para nuestro proyecto, la segmentaci´on es la etapa donde se localiza la imagen del iris. La etapa de segmentaci´on es muy importante ya que si el iris no es localizado correctamente las etapas posteriores utilizar´an datos err´oneos, por lo tanto el c´odigo generado contendr´a errores y el rendimiento del sistema ser´a muy bajo.

Existen diferentes mecanismos de segmentaci´on con distintos niveles de dificultad, entre los que podemos mencionar:

Umbralizaci´on.

Detecci´on de Bordes.

Detecci´on de Regiones.

Clustering.

Segmentaci´on de Texturas.

Morfolog´ıa Matem´atica.

Redes Neuronales.

A continuaci´on se describen algunos de estos m´etodos:

Umbralizaci´on. La forma m´as sencilla de segmentar una imagen es en el ca-so de que los distintos objetos se caractericen por niveles de gris diferentes. Para ello se puede emplear el histograma que indica el n´umero de puntos en la imagen que posee un determinado nivel de gris. La umbralizaci´on a partir de

histogramas consiste en elegir el punto de nivel de gris que separa los valores correspondientes al objeto y al fondo. En este m´etodo, a partir del l´obulo prin-cipal, es decir, del valor m´aximo, se considera como umbral al primer punto en el cual el gradiente se hace cero. Adem´as del c´alculo de histogramas, existen

otras t´ecnicas para calcular el umbral, tales como, el ajuste del l´obulo principal, m´etodo de la m´axima distancia, entrop´ıa y el algoritmo Isodata.

un cambio brusco entre niveles de grises con sus vecinos. Este tipo de filtro es el recomendado, a falta de informaci´on del tipo de ruido que afecta a una imagen. Esta etapa de suavizado debe llevarse a cabo de manera gradual ya que de realizarse de manera excesiva, se podr´ıan perder detalles importantes de la imagen (y por consiguiente de la regi´on del iris) y de gran importancia en este trabajo. Este suavizado se obtiene promediando los valores de intensidad de los pixeles en el entorno de vecindad con una m´ascara de convoluci´on de media cero y desviaci´on est´andarσ.

Sea f(x, y) una imagen corrompida con ruido y sea h(x, y) un filtro gaussiano con media cero y desviaci´on est´andar σ. σ determina el tama˜no del filtro y es seleccionado con base en el nivel deseado de detalle (bordes finos o gruesos) y en el nivel de ruido contenido en la imagen, calculado mediante la ecuaci´on 2.5:

h(x, y) = 1 2πσ2e

−x 2+y2

2σ2 (2.5)

• M´ascaras de Sobel.La convoluci´on se realizar´a con las siguientes m´ascaras de 3 x 3 en la direcci´on x y en la direcci´on y, las cuales se muestran en las matrices 2.6 y 2.7.

X =

−1 −2 −1

0 0 0

1 2 1

(2.6)

Y =

−1 0 1 −2 0 2 −1 0 1

(2.7)

2.3 Etapas del Reconocimiento 27

X =

−1 −1 −1

0 0 0

1 1 1

(2.8)

Y =

−1 0 1 −1 0 1 −1 0 1

(2.9)

• Laplaciano. En este caso, se utiliza la misma m´ascara para las compo-nentes x y para las componentes y, mostrada en la matriz 2.10.

X, Y =

0 1 0

1 −4 1

0 1 0

(2.10)

Segmentaci´on de Texturas.Se puede decir que una caracter´ıstica de textura de una imagen es un valor que cuantifica alguna caracter´ıstica de la variaci´on de la variaci´on del nivel de gris del objeto a segmentar en base a una disposici´on geom´etrica espec´ıfica. Para segmentar una imagen de textura buscamos una

caracter´ıstica que defina la textura, que tendr´a valores diferentes en cada una de las texturas de la imagen. De esta forma, calculamos una imagen nueva, en la que el valor en cada p´ıxel corresponde al valor del par´ametro en ese punto. Existen dos tipos de m´etodos para el an´alisis de texturas:

• Estad´ısticos. Basados en el histograma a partir de la media, la desviaci´on est´andar o la varianza de los niveles de gris. Tambi´en se utiliza la matriz de co-ocurrencia, que mide la probabilidad de que dos p´ıxeles a una distancia determinada tengan el mismo valor.

• Espectrales. Basados en el c´alculo de la Transformada de Fourier.

2.3.5.

Transformada Hough

En el procesamiento de im´agenes es com´un que existan formas regulares tales como l´ıneas, c´ırculos o pol´ıgonos. Muchas veces se requiere distinguir tales figuras del resto de la imagen, y para esto se requiere de algoritmos o herramientas poderosas que permitan realizar esta tarea. una de estas herramientas (y la usada en nuestro proyecto) es la Transformada de Hough.

2.3.6.

Extracci´

on de caracter´ısticas y/o firma del iris

Una vez que el iris ha sido localizado y sus correspondientes plantillas han sido generadas, en la etapa de segmentaci´on, se procede a la tercera etapa del proceso: la codificaci´on. El objetivo de la etapa de codificaci´on es extraer la informaci´on biom´etri-ca contenida en el patr´on de iris y generar un c´odigo asociado ´unico. El paso clave del

sistema ser´a extraer las caracter´ısticas del iris y determinar una forma adecuada de representaci´on. Interesa que dicho c´odigo contenga mucha informaci´on con una repre-sentaci´on sencilla para que facilite las etapas posteriores. Para determinar la correcta identificaci´on, se deber´a alcanzar un equilibrio entre la cantidad de informaci´on y el tama˜no de la representaci´on.

2.4.

M´

etricas para evaluar la similaridad entre dos

patrones

2.4.1.

Distancias de Hamming

La distancia de Hamming da una medida de similaridad entre dos patrones de bits. Usando la distancia de Hamming de dos patrones de bits, es posible tomar la decisi´on de que si dos patrones fueron generados a partir de iris distintos o del mismo. Al comparar los patrones de bits X y Y, la distancia de Hamming, DH es definida como la suma de bits no coincidentes (suma de la operaci´on OR exclusiva entre X y Y) sobreN, el n´umero total de bits en el patr´on.

DH = 1 N

N

X

j=1

Xj ⊕Yj (2.12)

2.4 M´etricas para evaluar la similaridad entre dos patrones 29

1 es de 0.5 y viceversa. Por lo tanto, la mitad de los bits coincidir´an y la otra mitad no, dados dos patrones de bits. Si dos patrones de bits son derivados del mismo iris, la distancia Hamming entre ellos debe ser cercana a 0.0, ya que estar´an altamente correlacionados y los bits de cada patr´on deber´an coincidir. La distancia de Hamming es la m´etrica de similaridad empleada en [2], y el c´alculo de dicha distancia es tomada s´olo entre bits que son generados a partir de la regi´on real del iris.

2.4.2.

Distancia Euclideana Ponderada

La Distancia Euclideana Ponderada (DEP) puede ser usada para comparar dos plantillas, especialmente si las mismas est´an compuestas de valores enteros. Esta m´etrica es empleada en [5] y se define por la ecuaci´on??

DEP(k) = N

X

i=1

(fi−fi(k))2

(δik)2 (2.13)

dondefi es laiesima caracter´ıstica del iris desconocido yfi(k) es laiesima caracter´ıstica de la plantilla, k, y δik es la desviaci´on est´andar de la iesima caracter´ıstica en la plantillak. La plantilla del iris desconocido se encuentra haciendo coincidir la plantilla k, cuando DEP se minimiza en k.

2.4.3.

Correlaci´

on Normalizada

La correlaci´on normalizada entre dos patrones de iris se representa con la ecuaci´on 2.14. CN = n X i=1 m X i=1

(p1[i][j]−µ1)(p2[i][j]−µ2)

nmσ1σ2

(2.14)

donde p1 y p2 son dos im´agenes de n x m pixeles. µ1 y σ1 son el valor promedio y

desviaci´on est´andar dep1 y µ1 yσ2 el valor promedio y desviaci´on est´andar dep2. La

Cap´ıtulo 3

Implementaci´

on del Mecanismo de

Autenticaci´

on

En este cap´ıtulo se presentan cada una de las etapas implementadas en este tra-bajo. Las etapas constitutivas son: adquisici´on de las im´agenes, segmentaci´on, codi-ficaci´on y reconocimiento. A continuaci´on se explican los algoritmos implementados en el mecanismo de autenticaci´on.

3.1.

Adquisici´

on de las im´

agenes

Para la realizaci´on de esta etapa se adoptaron dos bases de datos de im´agenes del iris disponibles para la evaluaci´on y prueba de este tipo de desarrollos; una es la Base de Datos Irisbath proporcionada por el Grupo de Procesamiento de Se˜nales e Im´agenes (SIPG) del Departamento de Ingenier´ıa El´ectrica y Electr´onica de la Universidad de Bath en Inglaterra. Irisbath est´a constituida por las im´agenes de 25 personas, de cada persona se tienen 20 im´agenes del ojo izquierdo y 20 del ojo derecho; es decir, en total son 1000 im´agenes, las cuales se encuentran e formato PGM (Portable Gray Map), que es un formato sencillo de im´agenes en escala de grises de tama˜no 1280 x 960 p´ıxeles en escala de grises de 8 bits por p´ıxel (8 bpp).

La otra Base de Datos es CASIA V1.0, otorgada por el Centro de Investigaci´on en Seguridad y Biometr´ıa de la Rep´ublica Popular de China. Estas im´agenes se en-cuentran en una escala de grises de 8 bpp, de tama˜no 320 x 280 p´ıxeles en el formato PGM. La base de datos contiene 756 im´agenes de iris de 108 personas distintas (7 im´agenes por persona), considerada de tama˜no suficiente para la evaluaci´on de este proyecto.

Las pruebas de los algoritmos se empezaron a realizar con la Base de Datos Iris-bath; sin embargo, en la etapa de segmentaci´on tuvimos conflictos con la memoria de la M´aquina Virtual de Java, ya que demandaba mucho poder de c´omputo por el

que contienen informaci´on de la regi´on inter´es, las im´agenes que se utilizaron fueron segmentadas.

En el caso del presente trabajo, los ´ındices visuales usados para lograr la seg-mentaci´on fueron los bordes del iris, y para esto fue necesario implementar un algo-ritmo de detecci´on de bordes.

3.2.1.

Operador de Canny

El algoritmo que empleamos para la etapa de segmentaci´on del iris fue el operador de Canny, que consiste en calcular la primera derivada del gaussiano. El algoritmo de Canny se basa en el uso de la primera derivada, ya que ´esta toma el valor de cero en todas las regiones donde no var´ıa la intensidad de la imagen, y tiene un valor constante durante toda la transici´on de intensidad. Por tanto, un cambio de intensidad se manifiesta como un cambio brusco en la primera derivada, es decir, en los picos de la primera derivada en la direcci´on del gradiente. Esta ´ultima, es una caracter´ıstica que es utilizada para detectar un borde, y en la que se basa el algoritmo de Canny mostrado a continuaci´on.

Algoritmo 1Operador de Canny Entrada: Imagen de entrada original.

1: Aplicaci´on de un filtro gaussiano a la imagen de entrada f(x, y).

2: C´alculo de la magnitud del gradiente G[s(x, y)] y de la orientaci´on θ(s(x, y)) de

la imagen filtrada.

3: Ajuste gamma a la imagen gradienteG[s(x, y)].

4: Supresi´on de no m´aximos a la salida del paso anterior.

5: Umbralizaci´on por hist´eresis para obtener la imagen con los bordes resaltados.

3.2 Segmentaci´on 33

Figura 3.1: Diagrama de la clase implementada del algoritmo de Canny.

A continuaci´on se muestra el fragmento del c´odigo fuente que implementa la clase canny; esta clase sirve para hacer el llamado a cada una de las partes que conforman el algoritmo de Canny: filtrado, c´alculo del gradiente y la orientaci´on, supresi´on de no m´aximos y umbralizaci´on por hist´eresis. Esto se hace mediante la definici´on de los objetos de las clases de estas etapas, lo cual llama a sus respectivos constructores para realizar todo el mecanismo.

public class Canny {

public Canny() { }

public static void main(String args[]) {

//FILTRADO DE LA IMAGEN

filtroGauss filtro=new filtroGauss(im,row,coll); //CALCULO DEL GRADIENTE

p2.write(”Gradiente”+a); p3.write(.Orientacion”+a);

p4.write(”GAMA”+a); p5.write(”NOmax”+a);

p6.write( ¨UmbralHisteresis”+a); }

}

Filtrado gaussiano

El filtro gaussiano fue aplicado a las im´agenes de entrada, con el fin de reducir la influencia de ruido en las mismas y obtener sus versiones suavizadas. La m´ascara de convoluci´on 3.1 empleada para la aplicaci´on del filtro se eligi´o con un valor de σ= 2 ya que este factor proporciona el grado de alisamiento de la imagen, y en este caso verificamos que este factor fuera el adecuado de tal manera que suprimiera el ruido suficiente sin eliminar los detalles del iris gracias a que los resultados que obtuvimos con ella fueron los mejores para los tratamientos posteriores de las im´agenes. Los filtros que se probaron se diferenciaban en el tama˜no de la m´ascara (3 x 3, 5 x 5, 7 x 7 y 9 x 9), as´ı como en las magnitudes de los elementos (diferentes valores deσ.

Para este caso se aplic´o el filtrado gaussiano debido a que no conocemos la natu-raleza del ruido que contamina a las im´agenes de Casia, y aunque se sabe que todas fueron adquiridas bajo las mismas condiciones, no se sabe el grado de precisi´on al tomarlas o las caracter´ısticas de la c´amara empleada; por lo que es necesario emplear un filtro que elimine este tipo de ruido sin reducir la informaci´on que se necesita para nuestro proceso.

3.2 Segmentaci´on 35

Figura 3.2: Gr´afica que muestra el comportamiento del filtro gaussiano

h=

0,0232 0,0338 0,0338 0,0338 0,0232 0,0338 0,0492 0,0558 0,0492 0,0338 0,0338 0,0558 0,0662 0,0558 0,0338 0,0338 0,0492 0,0558 0,0492 0,0338 0,0232 0,0338 0,0338 0,0338 0,0232

(3.1)

El mecanismo de filtrado se muestra a continuaci´on:

Algoritmo 2Filtrado gaussiano

Entrada: Imagen de entrada original f(x, y).

1: Convolucionarf(x, y) con la m´ascarah(x, y) dada en la ecuaci´on 3.1:

s(x, y) =f(x, y)∗h(x, y) (3.2) Salida: La salida es la imagen suavizada s(x, y).

En la figura 3.3 se muestra el diagrama de la clase que implement´o el mecanismo del filtrado gaussiano.

Este algoritmo utiliza la t´ecnica de filtrado conocida como filtrado espacial en la que se traslada una matriz rectangular de dos dimensiones (tambi´en llamada ventana, kernel, m´ascara o n´ucleo) que contiene ”pesos.o ponderaciones sobre la imagen en

Figura 3.3: Diagrama de la clase del Filtrado Gaussiano

Este mecanismo se ejemplifica en la figura 2.9 y el c´odigo que implementamos para esta etapa se muestra a continuaci´on.

public filtroGauss(short Inf[][],int fil,int colum) {

//Gaussiano de 5x5

G[0][0]=0.0232;G[0][1]=0.0338;G[0][2]=0.0338;G[0][3]=0.0338;G[0][4]= 0.0232; G[1][0]=0.0338;G[1][1]=0.0492;G[1][2]=0.0558;G[1][3]=0.0492;G[1][4]= 0.0338; G[2][0]=0.0338;G[2][1]=0.0558;G[2][2]=0.0632;G[2][3]=0.0558;G[2][4]= 0.0338; G[3][0]=0.0338;G[3][1]=0.0492;G[3][2]=0.0558;G[3][3]=0.0492;G[3][4]= 0.0338; G[4][0]=0.0232;G[4][1]=0.0338;G[4][2]=0.0338;G[4][3]=0.0338;G[4][4]= 0.0232; for(int ff=0;ff<filas;ff++)

{

for(int cc=0;cc<col;cc++) {

sumX=0;

3.2 Segmentaci´on 37

else if (cc==0k cc==filas-1 k cc==1k cc==col-2) sumX=0;

//convolucion else{

for(int I =−2; I <= 2; I++) {

for(int J =−2;J <= 2; J++) {

sumX=(sumX +(double)DATOS[ff+I][cc+J] * G[I+2][J+2]); } } } Ip[ff][cc]=(sumX); } } }

C´alculo del gradiente y orientaci´on

Despu´es del suavizado de la imagen se deben obtener los bordes de la im´agen y para lograrlo es necesario realizar operaciones puntuales sobre los p´ıxeles, es decir, operando para cada p´ıxel de la imagens(i, j), las cuales ser´an el c´alculo del gradiente y el c´alculo de la matriz orientaci´on.

Algoritmo 3C´alculo del gradiente y orientaci´on Entrada: Imagen suavizada s(x, y).

1: C´alculo de las componentes del gradiente Gx y Gy en las direcciones x y y

res-pectivamente.

2: C´alculo de la magnitud de los bordes utilizando la ecuaci´on:

G(x, y) =qG2

x+G2y (3.3)

3: Estimaci´on de la orientaci´on de la normal de los bordes, con la ecuaci´on:

θ(x, y) = arctanGy

Gx (3.4)

Figura 3.4: Imagen de ejemplo de la base de datos CASIA V1.0.

Figura 3.5: Imagen gradiente obtenida a partir de la figura 3.4.

En la figura 3.7 se observa el esquema de la clase en la que se realizan las opera-ciones del gradiente y la orientaci´on sobre cada p´ıxel de la imagen.

3.2 Segmentaci´on 39

Figura 3.6: Imagen orientaci´on obtenida a partir de la figura 3.4.

Figura 3.7: Diagrama de la clase que calcula la matriz gradiente y la matriz ori-entaci´on.

[image:42.612.171.449.272.628.2]} //OBTENCION DEL GRADIENTE[][] Y LA MATRIZ DE ORIENTACION[][] for(int i=0;i<row;i++)

{

for(int j=0;j<coll;j++) {

Grad[i][j]=Math.sqrt(Math.pow(X[i][j],2)+Math.pow(Y[i][j],2)); ANG[i][j]=Math.atan2(-1*(Y[i][j]),X[i][j]);

if(ANG[i][j]¡0) {

ANG[i][j]=ANG[i][j]+Math.PI; }

ANG[i][j]=(ANG[i][j]*180)/Math.PI; }

} }

3.2.2.

Correcci´

on gamma

Mediante la correcci´on gamma es posible ajustar el brillo de una imagen. Este ajuste se aplic´o a la imagen gradiente, para resaltar los bordes detectados. La expre-si´on matem´atica que se us´o para realizar esta correcci´on en las im´agenes, se presenta en la ecuaci´on 3.5.

Ga(x, y) = G(x, y)γ1 (3.5)

dondeγ es un valor contenido en el intervalo [0,2].

transfor-3.2 Segmentaci´on 41

maci´on nula, un valor menor a 1.0 crea curvas exponenciales que oscurecen la imagen, mientras que valores deγ mayores a 1.0 producen curvas logar´ıtmicas que aclaran la imagen.

Algoritmo 4Correcci´on gamma Entrada: Matriz gradiente.

1: Obtener el valor m´ınimo y m´aximo de los p´ıxeles de la imagen gradienteG(x, y),

es decir,min[G(x, y)] y max[G(x, y)].

2: Conγ = 1,7 (valor ´optimo para nuestra aplicaci´on) re-escalar la imagen gradiente

al rango [0,1] con la siguiente ecuaci´on:

G(x, y) = (G(x, y)−min[G(x, y)])/max[G(x, y)] (3.6)

3: Con la ecuaci´on 3.5, realizar el ajuste a la matriz gradiente de la siguiente forma:

Ga(x, y) = G(x, y)γ1 (3.7)

Para implementar este algoritmo, se hizo el ajuste gamma siguiendo las ecuaciones 3.6 y 3.7 y no se implement´o una clase que realizara estas operaciones; simplemente se anex´o el siguiente c´odigo despu´es del c´alculo de la matriz gradiente y de la matriz orientaci´on.

//CALCULO DE G=(G-Gmin)/Gmax; for(int i=0;i<row;i++) { for(int j=0;j<coll;j++) { Grad[i][j]=((Grad[i][j]-min)/max); } }

Algoritmo 5Supresi´on de no m´aximos Entrada: Matriz imagenGa(x, y).

1: Encontrar la direcci´on ˆdk que mejor aproxime la direcci´on de la normal al borde

θ(x, y). Para esto se consideran cuatro direcciones ˆd1,dˆ2,dˆ3 y ˆd4, correspondientes

a las ´angulos 45, 135 y 225 y 315 grados sexagesimales.

2: SiGa(x, y) es m´as peque˜no que al menos uno de sus dos vecinos a lo largo de la

direcci´on ˆdk, asignarN(x, y) = 0 (supresi´on); en caso contrario, asignarN(i, j) = Ga(x, y).

Figura 3.8: Imagen una vez suprimidos sus No m´aximos, proveniente de la imagen 3.4.

3.2 Segmentaci´on 43

public SupNoMax(double imagenentrada[][],double imagenorientacion[][],int fila,int columna) { for (int i=radioentero+10;i<fila-10;i++)

{

for (int j=radioentero+10;j<columna-10;j++) {

//Empieza Interpolacion Bilineal

promedioArriba= ti+horizontalfraccion[Orient]*(td-ti); promedioAbajo = li+horizontalfraccion[Orient]*(ld-li);

Fvalor=promedioArriba+verticalfraccion[Orient]*(promedioAbajo-promedioArriba); if (imagenentrada[i][j]¿Fvalor)

// Ha pasado un primer umbral {

x=j-DespX[Orient]; y=i+DespY[Orient];

//Obtenemos la localizacion en coordenadas enteras de los pixeles alrededor a x,y. fx=piso(x); cx=techo(x); fy=piso(y); cy=techo(y); ti=imagenentrada[fy][fx]; td=imagenentrada[fy][cx]; li=imagenentrada[cy][fx]; ld=imagenentrada[cy][cx];

// usamos la interpolacion bilineal

promedioArriba=ti+horizontalfraccion[Orient]*(td-ti); promedioAbajo=li+horizontalfraccion[Orient]*(ld-li);

3.2 Segmentaci´on 45

// Si pasa la segunda condici´on, el pixel // X en cuesti´on pasa a la salida

{ MatrizSup[i][j]=imagenentrada[i][j]; } } } } }

3.2.4.

Umbralizaci´

on por medio de hist´

eresis

La salida de la supresi´on de no m´aximos contiene cierto ruido en los m´aximos locales. Adem´as el contraste de la imagen de salida puede ser diferente en distintos puntos del contorno. Debido a esto, es necesaria una etapa de umbralizaci´on de la supresi´on de no m´aximos, para remover los bordes d´ebiles, pero que se conserve la conectividad de los contornos.

El objetivo principal de esta umbralizaci´on es descartar los m´aximos locales provo-cados por ruido, sin eliminar los bordes d´ebiles. Para esto se utilizan dos umbrales tbajo y talto, donde tbajo ≤ talto. Son tomadas en cuenta la imagen generada de la supresi´on de no m´aximos, la imagen orientaci´on de los puntos de borde y los valores de umbral. Para cada punto de la imagen se debe localizar el siguiente punto de borde no explorado que sea mayor al segundo umbral. A partir de dicho punto se siguen las cadenas de m´aximos locales conectados en ambas direcciones perpendiculares a la normal del borde, siempre que sean mayores al primer umbral. As´ı se marcan todos los puntos explorados y se almacena la lista de todos los puntos en el contorno conec-tado. Es as´ı como en este paso se logran eliminar las uniones en forma de Y, de los segmentos que confluyan en un punto.

Los imagen resultante de la umbralizaci´on por hist´eresis se muestra en la figura 3.10, y el esquema de la clase que implement´o este algoritmo aparece en la figura 3.11.

7: Asignarle la etiqueta elegida a los pixeles vecinos que cumplen la condici´on. 8: end if

Figura 3.10: Imagen una vez umbralada por hist´eresis proveniente de la imagen 3.4.

3.2 Segmentaci´on 47

Figura 3.11: Esquema de la clase que implementa la Umbralizaci´on por Hist´eresis 3.4.

for(int i=0;i<row;i++) //FILAS {

for(int j=0;j<col;j++) //COLUMNAS {

if((Entrada[i][j])>(supUmbral)) {

imUmbralada[i][j]=-1;

for(int in=i-1;in<=i+1;in++) {

for(int ic=j-1;ic<=j+1;ic++) {

if((Entrada[in][ic]¿inf U mbral)&(Entrada[in][ic]! = 255)) {

imUmbralada[in][ic]=255; }

El paso siguiente al del resaltado de bordes por el m´etodo de Canny consiste en la detecci´on de circunferencias en la imagen del ojo (la formada por el iris/pupila e iris/esclera); para esto se consider´o que el iris y la pupila son pr´acticamente circunfe-rencias perfectas; de esta manera se utiliz´o un mecanismo que detecta circunfecircunfe-rencias. En este trabajo, nos basamos en la Transformada de Hough.

Primero se realiza la extracci´on de los bordes a una imagen (mediante los algorit-mos previamente mencionados). Sobre estos bordes se aplica la transformada circular de Hough, lo que genera una imagen con circunferencias de cierto radio elegido, una circunferencia por cada uno de los puntos de los bordes. Las intersecciones de estas circunferencias determinan los puntos que podr´ıan corresponder al centro del circun-ferencia buscada.

En el caso de este trabajo, fueron 2 circunferencias (que se suponen conc´entricas) las que se buscaban. Adem´as, otra condici´on inicial fue, dado que en general todas las im´agenes del iris fueron tomadas en las mismas condiciones (o al menos en condiciones muy parecidas), ayudar al algoritmo, proporcion´andole un rango (de un valor m´ınimo a uno m´aximo) acotado para hallar el radio y reducir el espacio de b´usqueda del mismo, esto es, se le proporcion´o un valor m´ınimo y un valor m´aximo para el radio y el algoritmo halla el valor ´optimo (el m´as cercano) al radio real del iris y de la pupila.

Para el caso de la base de datos CASIA, fueron fijados los valores m´ınimos y m´aximos de los radios a trav´es de un an´alisis en todas las im´agenes de la base de datos y obteniendo la imagen que tuviera los radios m´aximos y m´ınimos para el iris y la pupila. Posteriormente se determin´o el 10 % de estos valores y el resultado se presenta a continuaci´on:

Pupila: radiomin = 25 y radiomax = 80

Iris: radiomin = 75 y radiomax = 155

3.2 Segmentaci´on 49

Algoritmo 7Transformada de Hough

Entrada: Mapa de bordes obtenido en la umbralizaci´on por hist´eresis.

1: Para cada punto del borde (cx, cy) existente en el plano N xM, generamos

cir-cunferencias de radio 1 hasta elnumradios y numradios es dado por el intervalo de b´usqueda entre radiomin y radiomax.

2: Hacer H(i, j, k)=AgregaCirculos(matrizAcumuladora, cx, cy) donde

matrizAcumuladora es un arreglo en 2D que se toma como variable acu-muladora.

3: La funci´on AgregaCirculos genera las coordenadas de los pixeles que

for-man una circunferencia perfecta de radio y centros dados y actualiza la matrizAcumuladora seg´un las coordenadas del pixel en el que se incide.

Salida: La salida generada por la transformaci´on son los par´ametros de la circunfer-encia encontrada: centro y radio.

la circunferencia interna iris/pupila, limitando la regi´on de la imagen donde se busca esta segunda, al radio de la primera circunferencia hallada.

[image:52.612.228.400.372.526.2]En la figura 3.17 se presenta el resultado parcial de la aplicaci´on de la transformada Hough, a la imagen de la figura 3.4 y en la figura 3.13 aparece un esquema que ejemplifica el funcionamiento de la transformada de Hough.

Figura 3.12: Imagen que muestra el resultado parcial de la transformaci´on Hough en la b´usqueda de la circunferencia iris/esclera.

3.2 Segmentaci´on 51

[image:54.612.146.488.109.473.2]La implementaci´on de la clase de la transformada Hough aparece en la figuras a 3.14 y b 3.15, as´ı como el fragmento de c´odigo que desarrolla este algoritmo.

3.2 Segmentaci´on 53

//MECANISMO DE LA TRANSFORMADA DE HOUGH //OBTENCION DE LAS COORDENADAS DE LOS //PIXELES CANDIDATOS ES DECIR BORDES for (int i=0;i<filas;i++)

{ for(int j=0;j<columnas;j++) { if(MatrizEnt[i][j]==255) { ptosX[index]=j; ptosY[index]=i; index++; } } }

for (int centro=0;centro<index;centro++) {

for(int Nradio=0;Nradio<numRadios;Nradio++) {

cX=ptosX[centro]; cY=ptosY[centro];

// SE LE ENVIA A LA FUNCION // PARA QUE A CADA VALOR DE // RADIO SE PINTE UN CIRCULO

// DE RADIO N EN LA REBANADA CORRESPONDIENTE AK=HOUGH(AK,cX,cY,Nradio+radiomin,numRadios);

para realizar pruebas de matriz }

}

{

mayor[k]=AK[i][j][k]; px[k]=j;

py[k]=i; }

} } }

//el mayor del mayor

for(int k=0;k<numRadios;k++) {

if(mayor[k]>Mmayor) {

Mmayor=mayor[k]; this.cX=px[k]; this.cY=py[k];

this.rFINAL=k+radiomin; }

}

3.3 Obtenci´on de la firma del iris 55

3.3.

Obtenci´

on de la firma del iris

Con el fin de obtener la representaci´on (firma) de la regi´on de iris, es necesario lograr la extracci´on de la misma, en una representaci´on rectangular normalizada de dimensiones constantes. Para ello, primero se obtiene la regi´on real que conforma al iris:

Algoritmo 8Extracci´on del iris

Entrada: Coordenadas del centro de la pupila e iris calculado por la transformada Hough.

Entrada: Radio de la pupila y radio del iris.

1: Generar una m´ascara que consiste de un c´ırculo de color negro sobre fondo blanco

cuyo centro y radio son los de la pupila.

2: Generar una m´ascara que consiste en un c´ırculo de color negro sobre fondo blanco

cuyo centro corresponde al de la pupila y el radio al del iris.

3: Eliminar en la imagen original los datos que se encuentren fuera de ambas

m´ascaras, para la obtenci´on de la regi´on del iris.

[image:58.612.227.399.368.526.2]Salida: El resultado de esta etapa es la extracci´on de la regi´on del iris.

Figura 3.16: Imagen que muestra la m´ascara utilizada para extraer la circunferencia interior (iris/pupila) de la imagen de entrada original.

Figura 3.17: Imagen que muestra la m´ascara utilizada para extraer la circunferencia exterior (iris/esclera) de la imagen de entrada original.

[image:59.612.226.398.455.606.2]3.3 Obtenci´on de la firma del iris 57

{ w=-1; }if(y<0) { k=-1; } for(int i=this.cY;i!=(y1+y);i=i+(k)) { for(int j=this.cX;j!=(x1+x);j=j+(w)) { im[i][j]=0; } } w=1; k=1; }

//SEGUNDA MASCARA IRIS

for (int ang=0;ang<2*Math.PI;ang=(float)(ang+(Math.PI/360))) {

3.3 Obtenci´on de la firma del iris 59 k=-1; } for(int i=this.cY;i!=(y1+y);i=i+(k))//filas { for(int j=this.cX;j!=(x1+x);j=j+(w))//columnas { im2[i][j]=0; } } w=1; k=1; }

//OBTENCION DE LA SEGUNDA MASCARA IRIS for(int i=0;i<row;i++) { for(int j=0;j<coll;j++) { if(im2[i][j]==0) { imORG[i][j]=imORG[i][j]; } else { imORG[i][j]=0; } } }

Entrada: La matriz de pixeles que contiene la regi´on real del iris. Entrada: Coordenadas del centro y radio de la pupila y del iris.

1: Obtener el n´umero de filas de la matriz que contendr´a la firma del iris.

2: Recorrido radial y angular que permite obtener cada uno de los p´ıxeles que

con-forman la regi´on del iris.

3: Los pixeles obtenidos en el paso anterior son almacenados en una matriz, en donde

cada radio de circunferencia referenciada corresponde a una fila de la matriz. Salida: La salida de esta etapa es una matriz que contiene la regi´on del iris en forma

rectangular, llamada firma del iris.

Cabe mencionar que en este algoritmo fue necesario establecer los valores de la matriz de p´ıxeles que contendr´ıan a la firma del iris, es decir, realizar un proceso de normalizaci´on en el tama˜no. Esto es debido a que el algoritmo de la extracci´on del iris obtiene fila por fila a los p´ıxeles que conforman al iris, lo que genera matrices con filas de diferentes tama˜nos, tal y como se muestra en la figura 3.20.

Figura 3.20: Imagen que muestra la firma del iris extra´ıda.

Para ejemplificar este procedimiento se puede observar la figura 3.21 y la figura 3.22.

3.3 Obtenci´on de la firma del iris 61

[image:64.612.205.413.87.327.2]Figura 3.21: Figura que ejemplifica el proceso de extracci´on del iris.

3.4 Reconocimiento 63

//OBTENCION DEL VECTOR FIRMA DEL IRIS

//OBTENCION DEL TAMA ˜NO MAXIMO POSIBLE DE LA FIRMA vector=sing(imORG,this.ptox,this.ptoy,radiomax); this.tamMAX=this.tamXY; FIRMA=new int[numRadios+1][this.tamMAX*8]; for(int i=0;i<numRadios;i++) { for(int j=0;j<this.tamMAX*8;j++) { FIRMA[i][j]=0; } }

//AHORA ES NECESARIO QUE SE REALICE DESDE //RADIO MINIMO HASTA RADIO MAXIMO

for(int pos=0;pos<numRadios;pos++) { vector=sing(imORG,this.ptox,this.ptoy,radiomin+pos); if(pos==0) { this.tamFinal=this.tamXY; } for(int j=0;j<this.tamXY*8;j++) { FIRMA[pos][j]=vector[j]; } } FIRMAFINAL=new int[numRadios+1][this.tamMAX*8];//[this.tamFinal*8];

3.4.

Reconocimiento

ponderaci´on previamente establecido, dependiendo de la regi´on a la que pertenez-ca.

3: Obtener un valor caracter´ıstico de cada firma, representado por la media

ar-itm´etica de las Distancias de Hamming Ponderadas.

3.4 Reconocimiento 65

regDist[i]++; TAM=i; }

} }

if(i>=0 && i<=25) {

regDist[i]=(int)(regDist[i]*0.7); }

if(i>25 && i<=40) {

regDist[i]=(int)(regDist[i]*0.2); }

if(i>40 && i<52) {

regDist[i]=(int)(regDist[i]*0.1); }

} } } }

Se toma la idea de Hamming en la cual se compara la similitud de dos entidades, le llamamos distancia de Hamming ponderada al c´alculo de la distancia de Hamming obtenida por el m´etodo descrito en el cap´ıtulo 2 multiplicado por un factor de pon-deraci´on el cual se obtiene din´amicamente en cada firma considerando el nivel de ruido que se encuentra presente en cada firma, de este modo tenemos dos casos.

3.4 Reconocimiento 67

ser´a multiplicado por un factor de ponderaci´on de 0.6 y el restante ser´a multi-plicado por 0.2, dividido en dos regiones correspondientes al 25 % y al 15 % del total de la firma.

gr´afica hecha con Java-Swing, con la finalidad de restringir el acceso a un recinto en el caso de una verificaci´on, donde se autentifica la identidad que una persona dice tener. Aunque se pueden considerar aplicaciones en las que s´olo se requiere saber si la persona pertenece a la base de datos (caso de la identificaci´on).

Mediante la interfaz gr´afica es posible comprobar el objetivo del proyecto que es la autenticaci´on de una persona. Principalmente consta de 4 ventanas, las cuales aparecen secuencialmente para comprobar que el usuario que ingresa al mecanismo es realmente qui´en dice ser.

En la figura 4.1 se solicita al usuario datos de nombre, apellido paterno y apellido materno, as´ı como una contras˜na, la cual valida al usuario en la primera etapa. ´Esta da acceso al sistema de reconocimiento que compara las distancias de Hamming de la imagen que se carga con las im´agenes del usuario que loa persona dice ser.

La segunda ventana muestra la im´agen del usuario cargada con las que se tienen previamente adquiridas; con el bot´on verificar se permite conocer el error de las comparaciones y si se encuentra dentro del rango aceptable para autenticar a la persona, lo hace, si no lo rechaza. Esto se muestra en las figuras 4.2, 4.3.

De la misma manera, al momento de oprimir el bot´on verificar el programa se encarga de mostrar las salidas generadas en las etapas descritas en el cap´ıtulo 3. ´

Estas se muestran en la figura 4.4. El c´odigo de la interfaz se muestra en los anexos.

69

Figura 4.1: Acceso al Mecanismo de Reconocimiento de Iris.

[image:72.612.121.505.338.660.2]71

en una interfaz gr´afica. Una vez conocido esto, consideramos necesario establecer el plan de pruebas referido a la parte algor´ıtmica con el fin de encontrar los mejores resultados, que proporcionen un desempe˜no ´optimo en dichas etapas. De la misma manera se hizo un plan de pruebas referido a la interfaz gr´afica, que permita evaluar el funcionamiento de esa aplicaci´on en particular.

5.1.

Evaluaci´

on del mecanismo de autenticaci´

on

Se llevaron a cabo las siguientes pruebas para el m´odulo del mecanismo de auten-ticaci´on de personas, basado en el reconocimiento del iris.

1. Medici´on del efecto del proceso de filtrado al variar los tama˜nos de las m´ascaras de convoluci´on. Referido a la etapa de filtrado se prob´o con 3 distintos tama˜nos

de m´ascara: 3x3, 5x5 y 7x7. Se eligi´o trabajar con la m´ascara de 5x5, porque se considera un tama˜no mediano de m´ascara que no demandar´ıa un alto poder de c´omputo, como en el caso de m´ascaras de tama˜no m´as grande, obteni´endose resultados aceptables como se muestra en la imagen 5.1.

2. Medici´on del rendimiento de la etapa de umbralizaci´on por hist´eresis al variar pares de umbrales seleccionados talto y tbajo. El principal reto de esta etapa

consiste en hallar un umbral superior y un umbral inferior, que permitan que en la imagen umbralizada se tenga la suficiente informaci´on, para que en la etapa de Hough sea posible determinar lo m´as exacto posible los valores del centro y radio de la pupila e iris. Se debe realizar la correcta elecci´on de estos

5.1 Evaluaci´on del mecanismo de autenticaci´on 73

Figura 5.1: Filtrado Gaussiano con m´ascara de 5x5

umbrales, dado que a partir de ellos se puede encontrar la informacion suficiente para la determinaci´on de los centros y los radios, pero al mismo tiempo puede arrojarnos demasiada informaci´on irrelevante, por lo que es necesario encontrar valores de umbrales, en los cuales se evite el ruido (informaci´on innecesaria), sin perder los datos que dar´an informaci´on importante a la etapa de Hough. En las im´agenes 5.2 y 5.3 se muestran los casos que ejemplifican las situaciones mencionadas

Figura 5.2: Imagen Umbralizada con talto = 0.20 y tbajo = 0.19 que no proporciona informaci´on suficiente.

En la figura 5.3 se observan los pixeles que definen la circunferencia correspon-diente al l´ımite entre el iris y la esclera, ´esta es la informaci´on necesaria para que el algoritmo de Hough determine los radios y los centros de manera precisa.

[image:76.612.225.401.400.553.2]