PROYECTO DE GRADO PARA OPTAR AL TITULO DE INGENIERO CATASTRAL Y GEODESTA

EXTRACCIÓN DE OBJETOS GEOGRÁFICOS MEDIANTE MORFOLOGÍA MATEMÁTICA A PARTIR DE TRANSFORMADAS WAVELET

AUTOR

GISELLE HELENA TORO GARAY

DIRECTOR

PhD. RUBEN JAVIER MEDINA DAZA

UNIVERSIDAD DISTRITAL FRANCISCO JOSE DE CLADAS FACULTAD DE INGENIERÍA

EXTRACCIÓN DE OBJETOS GEOGRÁFICOS MEDIANTE MORFOLOGÍA MATEMÁTICA A PARTIR DE TRANSFORMADAS WAVELET

AUTOR

GISELLE HELENA TORO GARAY

DIRECTOR

PhD. RUBEN JAVIER MEDINA DAZA

UNIVERSIDAD DISTRITAL FRANCISCO JOSE DE CLADAS

AGRADECIMIENTOS

A mi familia que siempre ha creído en mí y por quienes he llegado hasta aquí, quienes me enseñaron el valor de la perseverancia, la disciplina y el esfuerzo, a mi hermano Mauricio que siempre ha sido mi ejemplo

Agradezco a la Universidad Distrital Francisco José de Caldas por ser la cuna de mis sueños y brindarme la oportunidad de crecer como profesional y como persona, todo el tiempo que estuve en ella.

I

TABLA DE CONTENIDO

1. INTRODUCCIÓN ... 1

2. PROBLEMA ... 4

3. JUSTIFICACIÓN... 6

4. OBJETIVOS ... 8

Objetivo general ... 8

Objetivos específicos ... 8

5. MARCO TEÓRICO ... 9

5.1. Fusión de imágenes satelitales ... 9

5.1.1. Cambio de espacio de color HSI ... 10

5.1.2. Falsa pancromática ... 11

5.1.3. Pancromática ajustada ... 13

5.1.4. Índice de factor optimo ... 16

5.2. La transformada Wavelet ... 17

5.2.1. Wavelet Symlet 5 ... 18

5.3. La transformada Contourlet ... 18

5.3.1. Bancos de filtros direccionales ... 21

5.4. La transformada de Ridgelet ... 23

5.5. La transformada Curvelet ... 24

5.6. Criterio estadístico de selección ... 31

5.7. Criterio teórico de selección ... 35

5.8. Criterio Visual de evaluación ... 35

5.9. Objeto geográfico ... 37

5.10.Umbralización ... 39

5.10.1. Método Otsu ... 41

5.10.2. Método Kittler e Illingworth ... 44

5.10.3. Coeficiente kappa ... 46

5.11.Morfología Matemática ... 47

5.11.1. La erosión y dilatación ... 48

5.11.2. Transformación acierto o error ... 50

II

5.12.Clasificación supervisada ... 54

5.12.1. Evaluación ... 56

6. METODOLOGÍA ... 58

7. RESULTADOS ... 64

7.1. Preliminares ... 67

7.2. Aplicación Wavelet ... 70

7.3. Análisis y selección de Wavelet ... 70

7.3.1. Criterio Estadístico ... 70

7.3.2. Criterio Teórico... 72

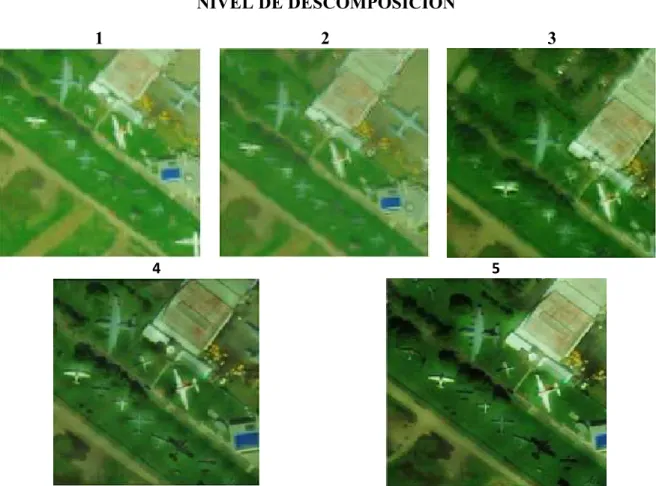

7.3.3. Criterio Visual ... 73

7.4. Generación de imágenes a partir del OIF, el ajuste de histogramas y composición ‘falsa pancromática’ ... 75

7.5. Transformada Contourlet ... 78

7.6. Transformadas Curvelet y Ridgilet ... 82

7.7. Evaluación de las imágenes fusionadas ... 89

7.8. Umbralización ... 91

7.8.1. Método Otsu ... 94

7.8.2. Método Kittler e Illingworth ... 100

7.8.3. Coeficiente Kappa ... 101

7.9. Morfología matemática. ... 103

7.9.1. Aplicación de algoritmos de morfología matemática ... 103

7.9.2. Evaluación ... 108

7.10.Validación de los resultados obtenidos ... 109

7.10.1. Imagen IKONOS ... 110

7.10.2. Imagen Landsat 8 (OLI) ... 122

7.11.Generación de mapas de clasificación de uso y cobertura de la tierra. ... 135

8. DISCUSIÓN DE RESULTADOS ... 140

9. CONCLUSIONES ... 143

10. TRABAJOS FUTUROS Y RECOMENDACIONES ... 146

BIBLIOGRAFÍA ... 148

III

ÍNDICE DE FIGURAS

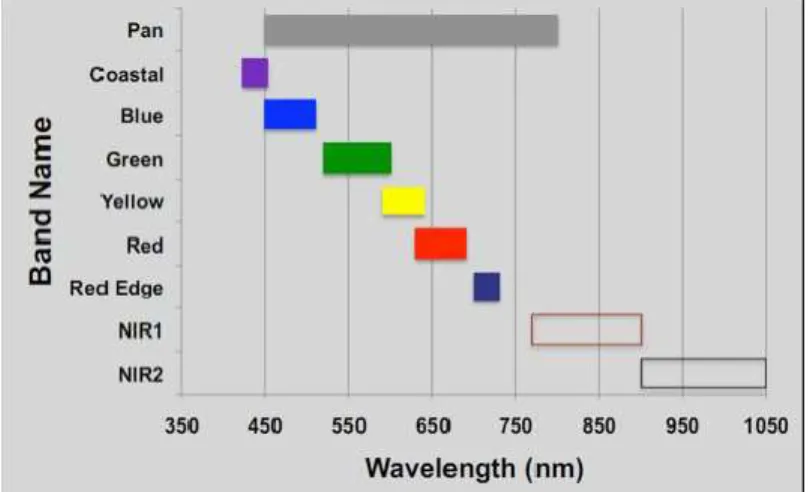

Figura 1. Longitud espectral de las bandas del sensor del satélite World View 2. ... 12

Figura 2. Proceso de igualación de histogramas. ... 14

Figura 3. Izquierda, Wavelets de soporte cuadrado sobre el contorno. Derecha, Contourlet soportes alargados para capturar mejor las discontinuidades ... 19

Figura 4.Piramide Laplaciana. ... 20

Figura 5. Formación de la pirámide Laplaciana, línea inferior, a partir de la pirámide Gaussiana, imagen superior. Imagen “Lady”. ... 20

Figura 6. a) Pirámide Laplaciana. b) Pirámide Wavelet. ... 21

Figura 7. De izquierda a derecha. Primer nivel de filtros, Ventilador. Segundo nivel de filtros, Cuadrados. Combinación de dos niveles de filtros. Partición de frecuencias con n=3 ... 22

Figura 8. Izquierda. Diagrama de bloques. Derecha. Combinación multiescala y multiresolución... 23

Figura 9. Implementación general de la transformada Curvelet. ... 26

Figura 10. Descomposición espacial de una sola banda ... 29

Figura 11. Análisis ridgelet de un fragmento de ridge ... 30

Figura 12. Ordenamiento primario de elementos fundamentales de imagen para proceso de análisis. .. 36

Figura 13 . Campo de búsqueda de la formulación alternativa del método Otsu ... 43

Figura 14. Diagrama de procesos. ... 58

Figura 15. A) Localización general zona de estudio. b) Localización especifica zona de estudio. Worldview-2. c) Imagen de trabajo principal. d) Zona de estudio. Worldview-2. ... 65

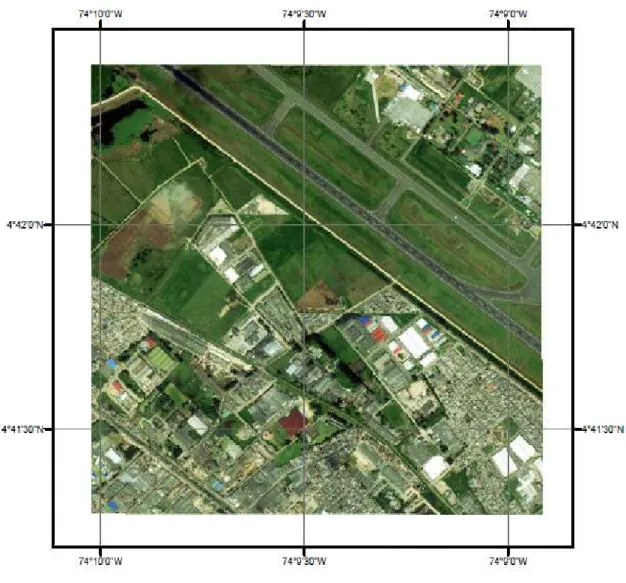

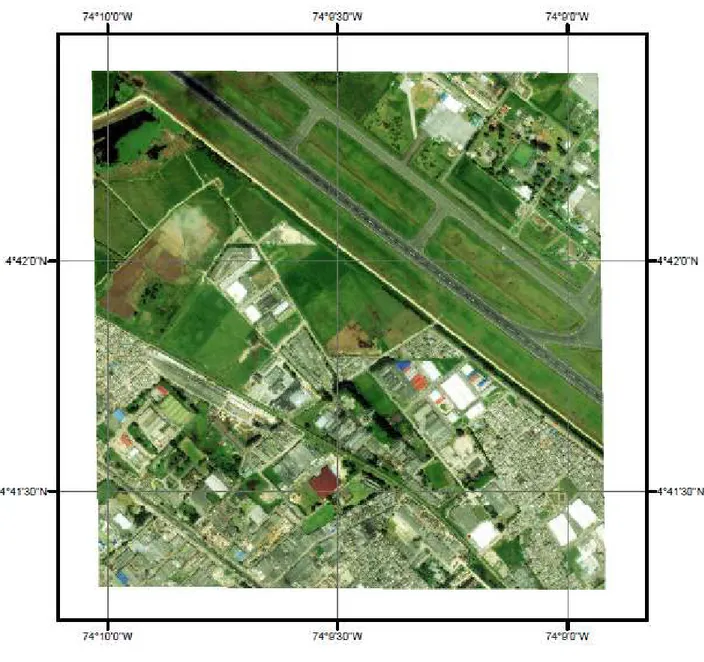

Figura 16. Imagen principal de trabajo. RGB (5,3,2) Tamaño de 4096x4096 píxeles ... 67

Figura 17. a) Transformación HSV, b) Componente Value extraído. ... 69

Figura 18. Imagen pancromática de la zona de estudio. ... 69

Figura 19. Referencia de la zona escogida para análisis visual ... 74

Figura 20. Niveles de descomposición 1-5 Wavelet Symlet 5, acercamiento a objetos espaciales de la imagen de estudio. ... 75

Figura 21. Imagen ‘falsa pancromática’, combinación RGB 851 ... 77

Figura 22. Histogramas. Izquierda, comportamiento histograma del Value. Derecha, histograma de la Pancromática. ... 77

Figura 23. A), b), c), d) 4 niveles de descomposición de la pirámide Gaussiana. c) Reconstrucción para la imagen a partir de pirámides Laplacianas. ... 79

Figura 24. Coeficientes Contourlet de la imagen fusionada. ... 80

Figura 25. Mapa. Nueva imagen RGB, fusionada a partir de los coeficientes Contourlet ... 82

Figura 26. Esquema de desarrollo de la Curvelet. a) Aplicación de la Ridgelet. B) Uso de los coeficientes en la Curvelet ... 86

Figura 27. Desarrollo Curvelet, usando Ridgelet local. a) . Imagen original, después de aplicada Wavelet Symlet 5 nivel 5. b) Imagen con estimación de ruido. c) Reconstrucción Curvelet ... 86

Figura 28.Desarrollo Curvelet, usando Ridgelet local. a) . Imagen original, rgb. b) Imagen con estimación de ruido. c) Reconstrucción Curvelet. ... 87

IV

Figura 30. Objetos geográficos para el proceso de umbralización dentro de las imágenes de trabajo. a) Avión. b) Cuerpo de agua. c) Estructura. d) Cubierta. e) Pista aérea. f) Cancha deportiva.

Objetos tomados de la imagen Symlet 5 nivel 5. ... 92

Figura 31. Ubicación de los diferentes objetos espaciales referidos dentro de la imagen. ... 93

Figura 32.Imagen umbralizada con el algoritmo propuesto y el algoritmo del software Matlab ... 94

Figura 33. Umbralización avión. a) imagen pancromática original. b) Imagen umbralizada ... 95

Figura 34. Umbralización cuerpo de agua imagen Wavelet symelt 5 nivel 5. a) original. b) Binarizada ... 95

Figura 35. Umbralización estructura imagen Falsa pancromática. Izquierda original. Derecha Binarizada ... 96

Figura 36. Umbralización cancha deportiva imagen original RGB y ajustada a la Pancromática. a) original RGB. b) BinarizadaRGB.d) Pancromática ajustada. b) Pancromática ajustada binarizada. ... 97

Figura 37. Umbralización Pista aérea imagen Contourlet, Curvelet y Ridgelet. Izquierda original. Derecha Binarizada ... 98

Figura 38. Umbralización Avión Contourlet, Curvelet y Ridgelet. Izquierda original. Derecha Binarizada ... 99

Figura 39. a) Umbral calculado con el método Kittler e Illingworth. b) Umbral calculado con el método Otsu. ... 100

Figura 40. Algoritmo de extracción de borde. a) Imagen Curvelet y Ridgilet. b) Imagen Contourlet. c) Imagen Curvelet y Ridgilet. ... 104

Figura 41. Rellenado de región a) Imagen Curvelet. b) imagen Contourlet. C) Imagen Curvelet ... 105

Figura 42. Algoritmo de adelgazamiento. a) y b) Imagen Contourlet. c) Imagen Curvelet y Ridgilet ... 106

Figura 43. Algoritmo engrosamiento. a) y b) Imagen Curvelet. c) Imagen Contourlet. ... 106

Figura 44. Aplicación algoritmo de esqueleto. a) Esqueleto avión, imagen pancromática. b) Esqueleto pista área, imagen Curvelet y Ridgilet. c) Esqueleto cuerpo de agua, imagen Contourlet ... 107

Figura 45. Zona de estudio orginial. Composición a color RGB 321. Imagen IKONOS ... 112

Figura 46. a) Imagen HSV. b) Imagen componente Value ... 113

Figura 47. Imagen Value nuevo, aplicando la Wavelet Symlet 5 en el nivel de descomposición 5. ... 114

Figura 48. Coeficientes Contourlet de la imagen IKONOS ... 116

Figura 49.Imágenes resultantes de las transformadas. a) Contourlet. b) Curvelet y Ridgilet ... 117

Figura 50. Objetos umbralizados por el método Otsu. Imagen IKONOS. a) Lago, Imagen Contourlet, b) Estructura, Imagen Curvelet y Ridgilet ... 118

Figura 51. Algoritmo extracción de bordes. a) Contourlet, lago b) Curvelet y Ridgilet, Vías. ... 119

Figura 52. Algoritmo rellenado de región . a) Contourlet, Lago b) Curvelet y Ridgilet, Vías. ... 120

Figura 53. Algoritmo adelgazamiento. a) Contourlet, lago. b) Curvelet y Ridgilet, vías ... 121

Figura 54. Algoritmo espesamiento. a) Contourlet, lago b) Curvelet y Ridgilet, vías ... 121

Figura 55. Algoritmo esqueleto. a) Contourlet, vías, b) Curvelet y Ridgilet, lago. ... 122

Figura 56. Zona de estudio, imagen Landsat 8... 124

Figura 57. a) Transformación al espacio HSV. b) Extracción componente Value ... 125

Figura 58. Imagen Value nuevo, aplicando la Wavelet Symlet 5 en el nivel de descomposición 5. ... 126

V

Figura 60. Imágenes resultantes de las transformadas. a) Contourlet. b) Curvelet y Ridgilet ... 128

Figura 61. Objetos umbralizados por el método Otsu. Imagen Landsat 8. a) Lago, Imagen Contourlet, b) Estructura, Imagen Curvelet y Ridgilet ... 130

Figura 62. Algoritmo extracción de bordes. a) Contourlet, b) Curvelet y Ridgilet ... 131

Figura 63. Algoritmo rellenado de región. a) Contourlet, b) Curvelet y Ridgilet ... 132

Figura 64. Algoritmo adelgazamiento. a) Contourlet, estructura b) Curvelet y Ridgilet, Lago ... 133

Figura 65. Algoritmo espesamiento. a) Contourlet, lago b) Curvelet y Ridgilet, Estructura ... 134

Figura 66. Algoritmo esqueleto. a) Contourlet, lago b) Curvelet y Ridgilet, estuctura ... 135

Figura 67. Zona utilizada para la clasificación. Imagen transformadas Curvelet y Ridgilet... 137

Figura 68. Diagrama de flujo creación de nuevas imágenes RGB. ... 165

VI

ÍNDICE DE TABLAS

Tabla 1. Criterio de clasificación del índice kappa ... 47

Tabla 2. Valoración para el coeficiente kappa. ... 57

Tabla 3. Datos de captura de la imagen Worldview-2. ... 65

Tabla 4.Longitudes de onda para la imagen worldview 2. ... 66

Tabla 5. Resultados Wavelet Symlet 5-5 a partir de los estadísticos. ... 71

Tabla 6. Resultados cinco Wavelets a partir de los estadísticos... 72

Tabla 15. Evaluación de la aplicación de morfología matemática sobre los objetos ... 109

Tabla 16. Especificación satélite IKONOS. ... 111

Tabla 17. Estadístico imagen fusionada con las diferentes Wavelet IKONOS ... 115

Tabla 18. Resultados de la evaluación de la umbralización con el coeficiente Kappa. Imagen IKONOS ... 118

Tabla 19.Especificaciones satélite Landsat 8. ... 123

Tabla 7. Correlación entre las ocho bandas que representan la imagen original... 76

Tabla 8. Mejores combinaciones RGB para la imagen objeto de estudio. ... 76

Tabla 9. Tamaño de las matrices de cinco niveles de descomposición para la imagen objeto de estudio. ... 80

Tabla 10. Definición de sub bandas de la Curvelet en la imagen objeto de estudio. ... 83

Tabla 11.Definición de cuadricula y soporte de la imagen objeto de estudio en la Curvelet ... 84

Tabla 12. Evaluación de las imágenes fusionadas ... 89

Tabla 13. Información de los objetos espaciales a Umbralización. ... 93

Tabla 14. Resultados de la evaluación del coeficiente kappa sobre la imagen Curvelet y Ridgilet ... 102

Tabla 20. Estadístico imagen fusionada con las diferentes Wavelet, Landsat 8. ... 126

Tabla 21. Resultados de la evaluación de la umbralización con el coeficiente Kappa. Imagen Landsat 8 ... 130

Tabla 22. Especificación de niveles de clasificación, metodología Corine Land Cover. Escala 1:10000. ... 136

VII

ÍNDICE DE SÍMBOLOS Y ABREVIATURAS

ω Frecuencia angular

f (t) Fase del contenido frecuencial

X(ω) Número complejo que da el modulo

ɛ, Є Valores pequeños aplicados a la localización en frecuencia transformada Wavelet

|𝑇|,|𝛺| Límites de los intervalos en donde está definida la Wavelet en el tiempo y la frecuencia respectivamente.

HSI Transformada de espacio de color Matiz, Saturación, Intensidad HSV Transformada de espacio de color Matiz, Saturación, Value 𝜓 (𝑥) < ɛ para |𝑥|>T Localización en tiempo transformada Wavelet

MM Morfología matemática

CC Coeficiente de correlación

Qu Índice de calidad universal

Po Porcentaje de aciertos

Pe Factor de corrección

ÉTxn Error estándar de kappa

I.C. [ Límite inferior del intervalo de confianza I.C.] Límite superior del intervalo de confianza

Z Cota z

P Probabilidad

Donc Conclusión estadística

wi,l Son Wavelets periódicas para [𝜋, 𝜋)

i Escala angular Ridgilet

l ∈ [0, 2i−1− 1] Localización angular Ridgilet

𝜓𝑗,𝑘 Wavelets Meyer para ℜ

j Escala Ridgilet

k Localización Ridgilet

ERGAS Erreur Relative Globale Adimensionalle de Synthèse

RASE Relative Average Spectral Error

DIV Divergencia

BM Bias de Media

E Entropía

VIII

GLOSARIO DE TÉRMINOS

Análisis espectral: Tiene por objeto la descomposición de la señal en sus diversas

componentes dentro del dominio frecuencial.

Análisis multitemporal: Análisis que se realiza mediante la comparación de las coberturas interpretadas en dos imágenes de satélite o mapas de un mismo lugar en diferentes fechas y

permite evaluar los cambios en la situación de las coberturas que han sido clasificadas. Cobertura del suelo: Hace referencia al aspecto morfológico y tangible del suelo, comprende todos los aspectos que hacen parte del recubrimiento de la superficie terrestre,que sean observados y permitan ser medidos con sensores remotos.

Diádico: Una diada (a dyad) consiste en la yuxtaposición de dos vectores, dígase AB. La

diada AB se lee «vector A veces el vector B» y es, a su vez, una suerte de producto externo denominado producto diádico. El resultado de este producto, que es la misma diada.

Exactitud de medida: se define como la proximidad existente entre un valor medido y un valor verdadero de un mensurando. Así pues, una medición es más exacta cuanto más pequeño es el error de medida.

Función continúa a trozos: f es continua a trozos en [a,b] si es continua en [a,b] excepto posiblemente en un numero finito de puntos en los cuales existen límites por la derecha y por la izquierda.

Función suave a trozos: f, es suave a trozos en [a,b] si es continua a trozos en [a,b], existe f’ y también es continua a trozos en [a,b].

Fusión de imágenes:

La fusión de imágenes es un proceso digital que permite reunir en una sola imagen el

IX

ctral.

Indempotente: Es la propiedad para realizar una acción determinada varias veces y aun así conseguir el mismo resultado que se obtendría si se realizase una sola vez. Un elemento que

cumple esta propiedad es un elemento idempotente, o un idempotente

Morfología matemática: Es una técnica de procesado no lineal de la imagen, interesada en la geometría de los objetos.

Píxel: Es la menor unidad homogénea en color que forma parte de una imagen digital, ya sea esta una fotografía, un fotogramade vídeo un gráfico.

Precisión de medida: como la proximidad existente entre las indicaciones o los valores medidos obtenidos en mediciones repetidas de un mismo objeto, o de objetos similares, bajo condiciones específicas.

Umbral: Los métodos del valor umbral son un grupo de algoritmos cuya finalidad es segmentar gráficos rasterizados, es decir separar los objetos de una imagen que nos

interesen del resto.

Resolución espacial: Este concepto designa al objeto más pequeño que se puede distinguir en la imagen.

Resolución espectral: Consiste en el número de canales espectrales (y su ancho de banda) que es capaz de captar un sensor.

X

Resolución temporal: Es la frecuencia de paso del satélite por un mismo punto de la

superficie terrestre. Es decir cada cuanto tiempo pasa el satélite por la misma zona de la Tierra. Este tipo de resolución depende básicamente de las características de la órbita.

Segmentación de imágenes: Se ocupa de descomponer una imagen en sus partes constituyentes, es decir, los objetos de interés y el fondo, basándose en ciertas características locales que nos permiten distinguir un objeto del fondo y objetos entre sí.

1

1. INTRODUCCIÓN

La resolución espacial de las imágenes satelitales es una de las características más

importantes para la realización de diferentes aplicaciones sobre las mismas, como la clasificación de coberturas de uso de la tierra, los estudios multitemporales, la generación de cartografía temática, (Lencinas & Siebert, 2009) y la morfología matemática entre

otros.

Por lo que se convierte en un problema cuando las imágenes no cumplen con la resolución

necesaria para los estudios que se desean realizar, y no es posible obtener otras imágenes algunas veces por características propias de la zona, como la humedad, vegetación densa o

el difícil acceso (Lencinas & Siebert, 2009).

Para solucionarlo, se han encontrado diferentes tratamientos para el mejoramiento de esta resolución en las imágenes, uno de ellos es la fusión que busca realizar la combinación de

componentes de diferentes resoluciones de un sensor o incluso de varios para lograr el mejoramiento (Medina, Joyanes, & Pinilla, 2013) . Algunos métodos de fusión conocidos actualmente son: transformada de Brovey, análisis de componentes principales,

transformación IHS, HSV y las Wavelet (Benzenati, Smara, & Massout, 2009) .

El presente trabajo toma como insumo una imagen del sensor del satélite WorldView 2,

determinando una zona de estudio sobre el Noroccidente de la ciudad de Bogotá D.C., con el objetivo, de mejorar la resolución espacial de la imagen para aplicar la morfología

2

manera dado que es su resultado más notable, y uso de morfología matemática sobre este

tipo de imágenes satelitales, ni sobre la zona de estudio.

Para lograrlo se realizaron sobre el área de estudio, una serie de procesamientos digitales

para mejorar su resolución a partir de varias familias de Wavelets estándar: Symlet, Daubechies, Haar, Biortogonal, Biortogonal inversa, Coiflet y Dmeyer, para su elaboración

se utilizó el método RGB-HSV, integrando la imagen pancromática, componente value con la intención de crear una nueva componente así generar una nueva imagen de composición

a color RGB para aplicar la descomposición Wavelet.

Todo este proceso fue evaluado con diferentes índices estadísticos matemáticos, ampliamente utilizados por varios autores para determinar la imagen fusionada con mejor calidad espacial, espectral y correlacionada con la original, estos estadísticos fueron

ERGAS, RASE, Coeficiente de correlación (CC) , Calidad universal (Qu) , Entropía,

Divergencia y Bias. (Vaiopoulos, 2011) .

Se determinó que la imagen que cumplía con el mayor índice de conservación de calidad espacial fue la tratada con la Wavelet Symlet 5 y el nivel de descomposición 5, se ajustaron las transformadas de mejoramiento de bordes Contourlet, Curvelet y Ridgilet con la

intención de determinar con cual se obtienen resultados de más alto grado de diferenciación de bordes, evaluando nuevamente con los estadísticos mencionados anteriormente, en

donde se encontró que la mejor era la Curvelet que requirió de la aplicación de Ridgilet previamente (Candµes & Donoho, 1999) .

Se escogieron varios objetos geográficos de tipo urbano presentes en el área de estudio y se

3

procesamientos anteriores, estos fueron sometidos primero a la umbralizacion, la cual se

realizó con el método Otsu (Otsu, 1975) y se evaluaron con el coeficiente Kappa. Terminado el proceso de Umbralización se aplicaron siete algoritmos de morfología

matemática: extracción de bordes, componentes conectados, rellenado de región, cubierta convexa, esqueletos, adelgazamiento y engrosamiento, con el objeto de mostrar el

comportamiento de estos sobre una imagen fusionada y mejorada.

Como último se generó como producto un mapa de clasificación de uso y cobertura del suelo con el sistema de clasificación Corine Land Cover adaptado a escala 1:10.000 para

demostrar la exactitud de la clasificación con una imagen sometida a las transformadas de mejoramiento de bordes y la imagen original.

Finalmente se validaron los resultados obtenidos sobre dos imágenes de diferentes sensores

y resoluciones con el fin de probar su precisión en la respuesta a diferentes escalas y resoluciones, estas imágenes fueron, LANDSAT 8 (OLI) e IKONOS, en las cuales se

escogió una nueva zona de estudio común entre ambas y con objetos similares a la imagen Worldview 2 y se aplicó nuevamente toda la metodología a excepción de la generación de

productos.

Con esto se demostró que las transformadas Curvelet y Ridgilet mejoran los bordes con mejores resultados para una imagen tratada previamente, y Contourlet para una sin

4

2. PROBLEMA

La morfología matemática (MM) se considera una herramienta útil para el procesamiento

digital de imágenes; en especial cuando se tienen cierto grado de ambigüedad o borrosidad en las formas y sus características (Poon, Chau, & Ghadiali, 1997) . Se han realizado

estudios usando la morfología como herramienta para la extracción de formas como edificios (Acar & Bayram, 2009) y clasificación con imágenes de alta resolución (Palsson, Sveinsson, Benediktsson, & Aanaes, 2010) . “La idea central de MM es el

proceso de examinar la estructura geométrica de una imagen, haciendo coincidir con pocos patrones en varios lugares de la imagen” (Acar & Bayram, 2009) , lo que convierte la

adquisición y tratamiento de la imagen previa un factor importante, para que el proceso morfológico tenga éxito, en la búsqueda de formas.

La adquisición de imágenes satelitales tiene un inconveniente, la resolución del píxel puede

aumentar o disminuir la zona estudiada (Akoguz et al., 2013) . Esta situación puede dificultar trabajos aplicativos como la generación de mapas temáticos, de uso y cobertura del suelo, procesamiento digital de imágenes y morfología matemática entre otros.

Las escenas Multiespectrales incluyen numerosas bandas del espectro de ondas electromagnéticas, provocando una resolución espectral más alta. Así mismo una alta

resolución espacial es incluida en la imagen pancromática. Con el fin de tener una imagen con una mayor resolución espacial y espectral, es aplicado el proceso llamado fusión. (Akoguz et al., 2013) . En esl presente trabajo se busca obtener una mayor resolución

espectral sobre las imágenes, para aplicar la morfología matemática.

Dentro de los métodos de fusión se encuentran: la transformada de Brovey, la

5

resolución espectral (Choi, Kim, Nam, & Kim, 2005) ; para obtener resultados de mayores

resoluciones espaciales; en la fusión se puede utilizar el análisis de las transformadas Contourlet, Curvelet y Ridgilet, estas representan los bordes mejor que las Waveletes, dado

que “el mejoramiento de bordes es un medio eficaz para aumentar la resolución espacial.” (Choi et al., 2005)

Una vez se tiene una imagen tratada que conserve en el más alto grado posible la resolución

espacial, es viable realizar la aplicación de la MM para obtener resultados más exactos, este estudio se inicia con el ánimo de aplicar la teoría matemática y estadística para producir

6

3. JUSTIFICACIÓN

La morfología matemática (MM) es una rama del procesamiento digital de imágenes,

creada por Jean Serra y George Matheron (Serra, 1982) , (Matheron, 1975) . Se ha considerado como “un método de gran alcance para el procesamiento de imagen; con

aplicaciones en la ciencia de materiales, imágenes microscópicas, reconocimiento de patrones, imágenes médicas, e incluso visión por computador (Acar & Bayram, 2009) .

Se basa en la teoría de conjuntos y los umbrales en las imágenes, entendidos como el valor

de referencia para realizar la sustitución de los niveles de gris por un valor que significa blanco o negro (Marques, 2011) ; además de implementar conceptos de otras áreas de

conocimiento como la ingeniería, las matemáticas en las que intervienen la teoría de retículos, los espacios continuos, discretos, los modelos estocásticos, topológicos, el análisis y procesamiento de señales y la física (Serra, 2007) .

En el ámbito de las imágenes satelitales la aplicación de algoritmos de MM, entre ellos la extracción de objetos realizado sobre objetos de tipo geográfico y urbano en el presente trabajo; permite hacer análisis multitemporales con imágenes de zonas específicas para

encontrar diferencias entre dos momentos, por ejemplo la construcción de nuevas edificaciones, la desaparición de algunas de ellas, o la identificación de estas (Acar &

Bayram, 2009) . También permite a partir de las características de las formas extraídas medir áreas para conocer el crecimiento o decrecimiento de cuerpos de aguas, de ciudades,

densidad de bosques, entre otros.

7

operaciones como la dilatación o la erosión, y la aplicación de los algoritmos como la

extracción de bordes o los esqueletos, es por esto que el presente trabajo presenta métodos de fusión con diferentes transformadas, Wavelet, Contourlet, Curvelet y Ridgilet,que han

sido previamente estudiadas (Pazmiño, 2012) y permiten conservar la mayor resolución espectral y espacial (Palsson et al., 2010) ; dado que no se encontraron estudios sobre el

tipo de datos, ni implementaciones sobre la zona de estudio escogida.

Los resultados permiten entregar un punto de partida para la realización de diversas aplicaciones ya mencionadas a partir de la fusión y la aplicación de algoritmos de la

8

4. OBJETIVOS

Se presentan a continuación los objetivos planteados que muestran el alcance del presente trabajo.

Objetivo general

Extraer objetos geográficos, sobre imágenes satelitales fusionadas con diferentes

transformadas Wavelet, Contourlet, Curvelet y Ridgilet

Objetivos específicos

Evaluar las imágenes resultantes de la fusión por medio de los estadísticos

matemáticos ERGAS, RASE, ENTROPIA, Coeficiente de Correlación (CC) , Calidad Universal (Qu) , Bias y Divergencia.

Usar los algoritmos de morfología matemática: extracción de bordes,

esqueletización, componentes conectados, espesamiento, adelgazamiento, cubierta

convexa y rellenado de región para extraer objetos.

Realizar validación de los resultados usando imágenes satelitales de los programas

IKONOS y LANDSAT 8

Generar un mapa de clasificación de uso y cobertura de la tierra que permita

identificar y comparar las zonas y sus respectivas coberturas de la imagen original

9

5. MARCO TEÓRICO

Para realizar la evaluación de las diferentes imágenes fusionadas se siguieron una serie de procedimientos previos, y varios criterios de selección una vez aplicadas las transformadas

Wavelet, Contourlet, Curvelet y Ridgilet, por lo que se hace necesario presentar el sustento teórico de este proceso.

5.1. Fusión de imágenes satelitales

“Hace referencia al proceso de combinación de imágenes de una escena desde diferentes

sensores para descubrir información que no se desprende de cualquier imagen por sí sola. Los métodos convencionales usados para este problema incluye la transformada de Brovey

(Gillespie, Kahle, & Walker, 1987) , transformada IHS (Tu, Su, Shyu, & Huang, 2001) , Análisis de los componentes Principales (PCA) (Chavez, Sides, & Anderson, 1991) y los métodos basados en Wavelet (H. Li, Manjunath, & Mitra, 1995) . Las imágenes fusionadas

deben coincidir con la imagen pancromática en detalle espacial y las propiedades de las bandas de baja resolución espectral. Los métodos PCA y la transformada Brovey, muestran

alta distorsión espectral.” (Divekar & Ersoy, 2009) .

La fusión de imágenes satelitales desempeña un papel importante en muchas aplicaciones

tales como detección remota, visión por ordenador y las imágenes médicas. Basado en el conjunto de datos disponible se utiliza en muchas otras (Anita & Moses, 2013) .

La fusión de imágenes se subdivide en nivel de píxel, nivel de funciones y nivel de

decisión. La fusión a nivel de píxel; se hace píxel por píxel a partir de la forma y se usa para fusionar los parámetros físicos, uso medio o nivel de funciones, para reconocer el

10

por separado y se toma la decisión basada en imágenes de entrada posteriormente de que es

hecha la fusión. (Anita & Moses, 2013).

5.1.1. Cambio de espacio de color HSI

Se usó en los procesos preliminares, la razón para utilizar este método es que “las operaciones de la transformada HSI tienen la capacidad de variar cada componente HSI de

manera independiente, sin afectar a los demás. Esta propiedad puede ser utilizada para la fusión de imágenes de sensores múltiples. Los pasos básicos de la fusión HSI son:

1. Registrar la entrada de la imagen multiespectral a la imagen pancromática si es necesario y posteriormente volver a muestrear a la misma resolución espacial que la de la

imagen pancromática.

2. Transformar la imagen multiespectral de entrada de RGB a espacio de color HSI.

3. Relacionar la intensidad, mientras que las variables, H y S representan matiz y

saturación respectivamente, reemplazar el componente de intensidad por una imagen pancromática con una resolución espacial superior;

4. Transformar el componente de intensidad sustituido, junto con componentes las de

matiz y saturación originales, de nuevo a el espacio de color RGB para crear la imagen fusionada” (Anita & Moses, 2013) .

Los espacios HSV y HSI están hechos bajo una transformación de coordenadas del RGB, dado que no son perceptibles para el ojo humano se denominan espacios intuitivos, u orientados al usuario y se codifican con los atributos de matiz, saturación y una

11

El algoritmo del HSV según (Ortiz , 2002) está definido en la ecuación 2.

𝐻 = cos−1[ 1

2 [(𝑅 − 𝐺) + (𝑅 − 𝐵)] √(𝑅 − 𝐺)2+ (𝑅 − 𝐵) (𝐺 − 𝐵) ]

Ecuación 1

Donde sí B>G, entonces H=360-H. El valor del matiz es un número entero en rango [0,360].

𝑠𝑖 max(𝑅, 𝐺, 𝐵) ≠ 0 𝑒𝑛𝑡𝑜𝑛𝑐𝑒𝑠 𝑆 =max(𝑅, 𝐺, 𝐵) − min (𝑅, 𝐺, 𝐵)

max(𝑅, 𝐺, 𝐵) , 𝑠𝑖 𝑛𝑜 𝑆 = 0

Ecuación 2

La componente acromática se calcula como se describe en la ecuación 4.

𝐕 = 𝐦𝐚𝐱 (𝐑, 𝐆, 𝐁)

Ecuación 3

5.1.2. Falsa pancromática

“Desde la pantalla del analizador no siempre se proporciona una óptima vista previa para ciertas clases de objetivos / objetos, un método realce visual es obligatorio. Esto permitirá

visualizar características de los objetos invisibles para el ojo humano.

La percepción del color es un elemento importante de la conciencia del medio ambiente. Diferentes objetos reflejan, emiten y transmiten diferentes cantidades y longitudes de onda

de la energía que se registra en el sensor como tonalidades de color o variaciones densidad. Las imágenes de color verdadero a menudo facilitan la interpretación proporcionando una

12

bajo investigación. En estos casos, el 'falso color' se utiliza con éxito para mejorar la

interpretabilidad mejorando el contraste a fondo de objeto a objeto” (Bratasanu, Nedelcu, & Datcu, 2012)

“en la mayoría de los casos, es la diferencia en el tono o color entre objetos, o entre y un fondo muy importante” (Colwell, Ulaby, Simonett, Estes, & Thorley, 1983) .

Se crearon dos nuevas imágenes para validar la información de la Wavelet y la

implementación de la morfología matemática.

La “falsa pancromática” (Divekar & Ersoy, 2009) (Medina Daza, Joyanes, Pinilla, Ardila,

& Pineda, 2013) y la ajustada pancromática.

La generación de la falsa pancromática se realizó teniendo en cuenta el rango espectral del

satélite que tomó la imagen de estudio, como lo muestra la siguiente Figura 1.

Figura 1. Longitud espectral de las bandas del sensor del satélite World View 2. (Taherzadeh, Shafri, Mansor, & Ashurov, 2012)

Se realizó la imagen con las bandas: Azul, Verde, Amarillo, Rojo y Rojo frontera; “Se seleccionaron estas bandas debido a que aproximadamente coincide con la ventana

13

Para la concatenación se utilizó la ecuación 5.

𝐵 + 𝐺 + 𝑌 + 𝑅 + 𝐸𝑅 6

Ecuación 4

Donde, B, banda Azul,G, Banda verde, R, Banda Roja y ER, banda rojo frontera.

5.1.3. Pancromática ajustada

Se hizo mediante el método de realce igualación de histogramas que “es el proceso de determinar una Tabla de búsqueda que convierte el histograma de una imagen que se

asemeja el histograma de otro. Es útil para hacer coincidir los datos de las mismas o adyacentes escenas que fueron escaneadas por separado en días, o son un poco diferentes

debido a ángulo de sol o los efectos atmosféricos. Esto es especialmente útil para mosaicos o detección de cambios.

Para lograr buenos resultados con ajuste de histograma, las dos imágenes de entrada deben tener características similares:

• La forma general de las curvas de histograma debe ser similar.

• Características oscuras y claras relativas en la imagen deben ser las mismas.

• Para algunas aplicaciones, la resolución espacial de los datos debe ser el mismo.

• Las distribuciones relativas de cubiertas de tierra deben ser de la misma, incluso cuando

hay búsqueda de escenas que no son de la misma zona.

Además matemáticamente “es un tramo lineal que redistribuye los valores de píxeles de

14

rango. El resultado se aproxima a un histograma plano. Por lo tanto, el contraste se

incrementa en los picos del histograma y disminuye en las colas”. (E. F. Guide, 1999) . La Figura 2, muestra el proceso descrito gráficamente.

Figura 2. Proceso de igualación de histogramas. (E. F. Guide, 1999)

La igualación de histograma se implementó en el software ERDAS IMAGINE (E. F. Guide, 1999) y se basa en la ecuación 6.

𝐴 = 𝑇 𝑁

Ecuación 5

Donde

N= El número de contenedores

T= El número total de píxeles en la imagen

A=El número de píxeles por contenedor igualados

15

de los contenedores pueden estar vacíos, en el caso que existan muchos contenedores o

muchos valores de píxel iguales (E. F. Guide, 1999) .

Para asignar los píxeles a los contenedores se utiliza la ecuación 7:

𝐵𝑗 = 𝑖𝑛𝑡 [(∑ 𝐻𝑘 𝑖−1

𝑘=1 ) + 𝐻𝑗

2

𝐴 ]

Ecuación 6

Donde

A= Número de píxeles por contenedor a igualar

𝐻𝑗 = Número de valores con el valor i

Int= Entero de la función, busca truncar los valores a enteros para el cálculo

𝐵𝑗= Número de contenedores por píxel con valor i

Se debe tener en cuenta que:

“El contraste entre los píxeles de la cola, que generalmente componen las regiones más oscuras y más brillantes de la imagen de entrada, se pierde.

El histograma resultante no es exactamente plano, ya que los píxeles rara vez se pueden agrupar juntos en contenedores con un número igual de píxeles.

16

5.1.4. Índice de factor optimo

Se realizaron combinaciones RGB, escogiendo la composición optima mediante el método

Índice de Factor óptimo OIF por sus siglas en inglés, el cual, “es un valor estadístico que se puede utilizar para seleccionarla combinación óptima de tres bandas de una imagen de

satélite para crear una composición de color. La combinación óptima de bandas fuera de todas las posibles combinaciones de 3 bandas es la que tiene mayor cantidad de información (la más alta suma de desviaciones estándar) , con la menor cantidad dela

duplicación (correlación baja entre pares de bandas ) ” (Li, Chen, &Sun, 2013) .

Se calcula en dos pasos:

El primero es hallar la cantidad de bandas que se pueden combinar mediante la

ecuación 8.

𝑁3 =

𝑁! 3! ∗ (𝑁 − 3)

Ecuación 7

Donde N es el total de bandas en la imagen

La segunda es el cálculo del índice OIF usando la ecuación 9.

𝑂𝐼𝐹 = 𝑆𝑡𝑑𝑖 + 𝑆𝑡𝑑𝑗+ 𝑆𝑡𝑑𝑘 |𝐶𝑜𝑟𝑟𝑖,𝑗| + |𝐶𝑜𝑟𝑟𝑗.𝑘| + |𝐶𝑜𝑟𝑟𝑖,𝑘|

Ecuación 8

Donde 𝑆𝑡𝑑𝑖, es la desviación estándar de la Banda I;

𝑆𝑡𝑑𝑗, es la desviación estándar de Bandj;

𝑆𝑡𝑑𝑘, es la desviación estándar de Band k;

17

𝐶𝑜𝑟𝑟𝑖,𝑘, es el coeficiente de correlación de Banda i,Banda k;

𝐶𝑜𝑟𝑟𝑗.𝑘, es el coeficiente de correlación de Banda j, k

5.2. La transformada Wavelet

Consiste en descomponer la señal por medio de ciertas funciones Wavelet, las cuales se

obtienen a partir de una función Wavelet madre. La descomposición permite obtener unos coeficientes que son susceptibles de interpretación y posterior manipulación (Balbuena,

2007) . Formalmente según (Victorino, 2011) la transformada Wavelet es una descomposición multi-escala, desarrollada para analizar funciones o señales de una dimensión y ha demostrado que es la representación óptima en señales suaves a trozos, con

un número finito de discontinuidades. Las bases Wavelet son funciones 𝜓 Є 𝐿2 (R) que

cumplen con dos condiciones: están localizadas en tiempo y frecuencia, es decir 𝜓 (𝑥) < ɛ para |𝑥|>T, con T<∞ y su transformada de Fourier 𝜓 (𝜉) < ɛ con |𝜉|>Ω, con Ω<∞, aquí ɛ,

Є son valores muy pequeños y |𝑇|,|𝛺| marcan los límites de los intervalos en donde está

definida la Wavelet en el tiempo y la frecuencia respectivamente. La segunda es la condición de admisibilibilidad dada por:

𝟐𝝅 ∫|𝝍(𝝃)|𝟐∗ |𝝃|−𝟏𝒅𝝃 < ∞. Se asume que ‖𝝍‖ = 𝟏 y que ∫ 𝝍(𝒙)𝒅𝒙 = 𝟎∞ −∞

Ecuación 9

Se aplicaron las Wavelet Haar, Daubechies, Symlet, Coiflet, Biortogonal, Biortogonal

inversa y Dmeyer estas son “familias Wavelet estándar, incluyendo filtros Wavelet Daubechies, Morlet complejo y Gauss, biortogonal inversa real y discreta Meyer” (M. U. Guide, 1998)

18

coeficientes “para el análisis, la codificación, la compresión, la reconstrucción y el

modelado de (…) imágenes” ( Guide, 1998) .

5.2.1. Wavelet Symlet 5

Pertenece a una familia Wavelets derivadas del nombre “symmetrical Wavelets”, se crearon con el objetivo fundamental de obtener la mayor simetría posible en las funciones a aplicar

(Sarría, 2007) .

No son perfectamente simétricas, pero se diseñaron con la intención de conseguir un

soporte relativamente compacto y el mayor número de momentos nulos (Sarría, 2007) .

Las Wavelet pueden clasificarse en tres grandes grupos según su simetría: Simétricas, casi simétricas y asimétricas, (Pazmiño Altamirano, 2012) . “Las funciones Wavelet casi

simétricas, como las Coiflet o las Symlet, siguen teniendo un soporte mínimo en el intervalo [-p+1, p] con p momentos nulos, pero tienen filtros asociados más simétricos

respecto del centro de su soporte y por ello no se concentra la energía de la imagen en uno u otro extremo sino que se concentra en la parte central” (Sarría, 2007) . Por esto sus raíces se seleccionan “de otro conjunto que tengan simetría más cerca, pero con fase lineal

compleja” (Chun-Lin, 2010) .

A partir de la Wavelet existen generalizaciones y extensiones como es el caso de las

transformadas de Contourlet, Curvelet y Ridgilet («Curvelet Home», 2015)

5.3. La transformada Contourlet

El propósito principal de la elaboración de la Contourlet es “realizar una expansión dispersa de las imágenes típicas que son suaves por partes pero que están lejos de ser contornos

19

características de direccionalidad y captura de contornos, así mismo posee particularidades

de las Wavelet entre ellas la multiescala, tiempo frecuencia y localización (Vitousek, 1994) , adicionalmente gozan de alto grado de direccionalidad y anisotropía (Daza et al.,

2011) .

La mayor ventaja de estas transformada de Contourlet es la posibilidad de mejorar los

contornos, o representar contornos suaves con menos coeficientes de los proporcionados por las Wavelet, sus funciones base, están orientadas en potencias de dos, con respecto al número de direcciones y permiten relaciones de aspecto flexible (Minh N. Do & Vetterli,

2003) . Los soportes de las Wavelet son cuadrados, lo que solo permite capturar discontinuidades puntuales, por el contrario las Contourlet, tiene soportes alargados que

capturan con más suavidad los contornos, en la Figura 3 se describe esta situación, en donde se encuentra a la izquierda el soporte de las Wavelets y a la derecha el de las

Contourlet.

Figura 3. Izquierda, Wavelets de soporte cuadrado sobre el contorno. Derecha, Contourlet soportes alargados para capturar mejor las discontinuidades

(Minh N. Do & Vetterli, 2003)

Para realizar la construcción de la Contourlet primero se debe realizar la pirámide

20

siglas en inglés (LP) . En la Figura 4, se observa la descomposición en 5 niveles de la

pirámide Gaussiana, la cual es necesaria para producir la pirámide Laplaciana.

Figura 4.Piramide Laplaciana. Descrita en (Burt& Adelson, 1983)

El propósito general de este proceso de codificación en encontrar valores dentro de G1 que sirvan como predicción para G0, donde la función Laplaciana se forma de la resta de dos funciones Gaussianas provenientes de la ampliación de G1 y la resta de G0, y por esta

razón la imagen que contiene el error se convierte en el nivel inferior de la pirámide proceso sucesivo para los demás niveles de la misma (Balbuena, 2007) . Finalmente se

puede decir que la pirámide Laplaciana se genera de la sucesión de errores, formándose de la diferencia entre los errores de la pirámide Gaussiana. La Figura 5 describe la formación

de la pirámide Laplaciana a partir de la pirámide Gaussiana.

Figura 5. Formación de la pirámide Laplaciana, línea inferior, a partir de la pirámide Gaussiana, imagen superior. Imagen “Lady”.

21

La Figura 6a) , representa la descomposición de la pirámide Laplaciana, generada partir de la disminución en tamaño en factor de 2, mientras que la la Figura 6a) , muestra que la Wavelet es dividida entre 6 por los filtros y toma una parte de los factores (aproximación) ,

para el siguiente nivel de descomposición.

a) b)

Figura 6. a) Pirámide Laplaciana. b) Pirámide Wavelet.

(Balbuena, 2007)

Dado que el análisis de la transformada Contourlet se hace también de forma direccional es necesario aplicar el concepto de bancos de filtros direccionales.

5.3.1. Bancos de filtros direccionales

La descomposición direccional se introdujo con el concepto de bancos de filtros direccionales DBF de sus siglas en inglés, fueron diseñados para capturar componentes a altas frecuencias, por lo que las bajas frecuencias no pueden ser tratadas por los DBF, este

es el motivo por el cual se hizo necesario combinar el analisis con los esquemas de multiresolución (Daza, Aguilar, Ruiz, Ardila, & Pineda, s. f.) . Con este fin los DBF se

22

& Vetterli, 2005) tal y como se observa en la Figura 7, en donde se encuentran los

diferentes tipos de filtros aplicados, en donde se encuentran, ventilador, cuadrados y la combinación del mismo, con frecuencia de uso igual a 3.

Figura 7. De izquierda a derecha. Primer nivel de filtros, Ventilador. Segundo nivel de filtros, Cuadrados. Combinación de dos niveles de filtros. Partición de frecuencias con n=3

(Balbuena, 2007)

Por otro lado la descomposición multiescala busca la aplicación de la piramide laplaciana al

banco filtros direccionales piramidales, estos ortogonales y submuestreados de orden dos para cada dimensión (Balbuena, 2007) . Para esto se genera una secuencia de espacios

jerarquizados que son invariantes al corrrimiento y a la escala, dado que el subespacio creado esta definido sobre una repartición uniforme de intervalos, que caracteriza la aproximación de la imagen a la resolución; y los detalles para incrementar la resolución

estan guardados en las imágenes de la piramide Laplaciana (Minh N. Do & Vetterli, 2003) . Finalmente con las LP (Piramides Laplacianas) , es posible utilizar los DBF, a traves de

las pasabandas, lleva a la captura eficiente en altas frecuencias de información direccional (Daza et al., s. f.) , sin embargo como las frecuencias bajas no son tenidas en cuenta en este proceso es necesario eliminarlas antes del filtrado; la repetición del procesamiento genera

23

Esta porporciona una dirección diferente en cada escala y el anáisis se hace mas flexible y

preciso. En la Figura 8 se muestra graficamente la descomposicion multiescala y direcional aplicadas, y asi mismo la descomposición multiresolución que resulta ser la combinación

de las primeras.

Figura 8. Izquierda. Diagrama de bloques. Derecha. Combinación multiescala y multiresolución.

(Daza et al., s. f.)

5.4. La transformada de Ridgelet

Propuesta en la tesis doctoral de Emmanuel Càndes (Candes, 1998) , se especifica así (Candès & Donoho, 1999) :

En 𝑅2 se define una función suave univariante 𝜓: 𝑅 → 𝑅 con suficiente decadencia y fuga

media ∫ 𝜓(𝑡)𝑑𝑡 = 0. Para cada a>0, cada b Є R y cada 𝜃 Є [0, 2𝜋), se define la función

bivariante de 𝜓𝑎,𝑏,𝜃: 𝑅2 → 𝑅2 por la ecuación 11.

𝝍𝒂,𝒃,𝜽(𝒙) = 𝒂−𝟏/𝟐. 𝝍 ( (𝐜𝐨𝐬 ( 𝜽) 𝒙𝟏+ 𝐬𝐢𝐧(𝜽)𝒙𝟐− 𝒃) /𝒂) ) Ecuación 10

Esta función es constante a lo largo de las “ridges o crestas”

cos ( 𝜃) 𝑥1+ sin(𝜃)𝑥2 = 𝑐𝑜𝑛𝑠𝑡.

24

Transversa a estas ridges es una Wavelet, de allí el nombre de Ridgelet. Dada una función

integrable bivariante f (x) se definen los coeficientes de Ridgelet. Su dimensión según (Balbuena, 2007) está dada por la ecuación 12.

𝝎 ∈ |𝟐𝒔, 𝟐𝒔+𝟏| Ecuación 12

Ya que es una función Wavelet a una escala a lo largo de la dirección ortogonal.

5.5. La transformada Curvelet

Fue propuesta por (Candµes&Donoho, 1999) , dadas las continuas necesidades de análisis

de imágenes que ya no eran cubiertas por las transformadas Wavelet o Fourier, se desarrolló principalmente en el contexto de los objetos y formas, para representar bordes de

discontinuidades a lo largo de curvas, mucho mejor que las transformadas Wavelet.

Mediante la Curvelet existe la posibilidad de realizar una reconstrucción con buena precisión mediante una cantidad mucho menor de coeficientes en el proceso (Donoho&

Duncan, 2000) .

En términos generales según (Donoho& Duncan, 2000) con una reconstrucción a partir de

la Wavelet se obtiene un error al representar un borde de 1/N; mientras que con las Curvelet

se obtiene únicamente un error de 1/√𝑁 coeficientes.

Entonces la transformada de Curvelet “es una transformada multiescala, con elementos de marco indexados por parámetros de escala y ubicación, además de un alto grado de

especificidad en su pirámide de construcción. Se basa además en un principio escalar anisotrópico que las Wavelet no tienen dado que para sus ondas es únicamente isotrópico”

25

También comparten unas características de escalamiento especial, donde la longitud de apoyo de los elementos y la anchura están vinculados mediante 𝑎𝑛𝑐ℎ𝑜 ≈ 𝑙𝑜𝑔𝑖𝑡𝑢𝑑2

Se hace uso de unos cuadros ajustados para el espacio 𝐿2(𝑅2) conformados por un conjunto

de análisis de elementos indexados en tuplas (Donoho& Duncan, 2000) (Emmanuel &Donoho, 2000) que cumple con las siguientes propiedades principales:

Definición de la transformación

∝𝜇= 〈𝑓, 𝛾𝜇〉, 𝑑𝑜𝑛𝑑𝑒 𝜇 𝜖 𝑀′

Ecuación 13

Relación de Parseval

‖𝑓‖22 = ∑ |∝𝜇| 2

𝜇 𝜖 𝑀′

Ecuación 14

Formula de reconstrucción de 𝐿2

𝑓 = ∑ 〈𝑓, 𝛾𝜇〉𝛾𝜇 𝜇 𝜖 𝑀′

Ecuación 15

Estas propiedades son equivalentes a una base ortonormal y permiten una estabilidad de la representación (Donoho& Duncan, 2000) .

En la Figura 9, se muestra el proceso de la construcción de la Curvelet que requiere de la aplicación de bancos de filtros, la escala de la cuadricula a utilizar, el análisis Ridgilet, y su

26

Figura 9. Implementación general de la transformada Curvelet.

(Donoho& Duncan, 2000)

Estos pasos necesarios en la construcción y mejoramiento de la imagen son:

Descomposición sub-banda: La imagen es dividida en bandas de resolución, definiendo un banco de filtros de la subbanda P0, (∆𝑠, 𝑠 ≥ 0). El objeto 𝑓 es filtrado en sub bandas como

muestra la ecuación 16.

𝑓 → (P0𝑓, ∆1𝑓, ∆2𝑓, … )

Ecuación 16

Cada banda contiene detalles de diferentes frecuencias

P0 Contiene el filtro paso- bajo

∆1, ∆2, … Contiene el filtro pasa banda y los detalles 2−2𝑠 del ancho (Devir & Shpinner,

2006) (Emmanuel & Donoho, 2000)

Partición de superficies suaves: Se definen una colección de ventanas lisas 𝑤𝑄(𝑥1, 𝑥2)

27

𝑄 = [𝑘1 2𝑠, (

𝑘1+ 1 2𝑠 )] 𝑋 [

𝑘2 2𝑠 , (

𝑘2+ 1 2𝑠 )]

Ecuación 17

En esta etapa del procedimiento, se aplica esta disección de ventanas a cada una de las

sub-bandas aisladas en la etapa anterior del algoritmo” (Donoho& Duncan, 2000) .

En este procedimiento se deben considerar varios asuntos importantes, buscando la

reconstrucción exacta de la imagen, se construyó la función de ventana, es una función w lisa no negativa que proporciona una partición de la energía dada por la ecuación 19.

∑ 𝐰𝟐 (𝐱

𝟏− 𝐤𝟏, 𝐱𝟐− 𝐤𝟐) 𝐤𝟏𝐤𝟐

≡ 𝟏, ∀ (𝐱𝟏, 𝐱𝟐)

Ecuación 18

También la fórmula de reconstrucción dada por la ecuación 20.

∑ 𝑤𝑄. ℎ𝑄 𝑄∈ ℌ𝑠

= ∑ 𝑤𝑄2. ℎ = ℎ, 𝑄∈ ℌ𝑠

Ecuación 19

Y finalmente la propiedad de conservación de la energía, presentada en la ecuación 21

(Donoho& Duncan, 2000)

∑ ‖ℎ𝑄‖22 𝑄∈ ℌ𝑠

= ∑ ∫ 𝑤𝑄2ℎ2 = 𝑄∈ ℌ𝑠

∫ ∑ 𝑤𝑄2ℎ2 𝑄∈ ℌ𝑠

= ∫ ℎ2 = ‖ℎ 𝑄‖22

Ecuación 20

Renormalización: Para el cuadro Q, se tiene la ecuación 22, aplicada así:

(𝑇𝑄𝑓)(𝑥1, 𝑥2) = 2𝑠𝑓(2𝑠𝑥1− 𝑘1, 2𝑠𝑥2 − 𝑘2)

28

“Denota el operador que transporta y normaliza f de manera que la parte de la entrada apoyado cerca de Q se convierte en la parte de la salida apoyada cerca de [0,1]2.

En esta etapa del procedimiento, cada “cuadrícula” resultante en la etapa anterior se

renormalizado a escala de unidades” (Donoho& Duncan, 2000) .

𝑔𝑄 = (𝑇𝑄)−1(𝑤𝑄∆𝑠𝑓), 𝑄 ∈ ℌ𝑠

Ecuación 22

Es decir centra cada cuadro diádico a las unidad cuadrada [0,1]X[0,1] (Devir & Shpinner,

2006)

Análisis Ridgelet: Cada cuadricula es analizada en el sistema ridgelet ortonormal. Este es un sistema de elementos de la base 𝜌𝜆 que produce una ortobase para 𝐿2(𝑅2)

∝𝜇= 〈𝑔𝑄, 𝜌𝜆〉, 𝜇 = (𝑄, 𝜆)

Ecuación 23

Es decir si se tiene un objeto f, que representa el borde, una vez se realiza el filtrado por

sub-banda, cada proceso da como resultado la producción de una sub banda de escala fina, que contendrá un mapa de los bordes engrosados en un factor 2−2𝑠 de acuerdo al operador

de filtro de sub banda. Esto provee a la sub banda una colección de crestas lisas (ridges) . Cuando se divide, entonces cada sub banda en “cuadriculas”, si existe un cuadro vacío, es decir, el cuadro no tiene cruces con el borde; o un fragmento de cresta. Las ridges son casi

29

El proceso anterior se puede evidenciar en la Figura 10, en la cual se observa el proceso de

entrada del objeto f, del que es producida la cuadricula, separados los bordes a lo largo de la cuadricula y el aislamiento de cada cuadro donde únicamente se toman los que tienen

coincidencia con los bordes.

Figura 10. Descomposición espacial de una sola banda

(Donoho& Duncan, 2000)

Las ridgelet divide el dominio de la frecuencia en coronas diádicas |𝜉|𝜖 [2𝑠, 2𝑠+1], en su dirección angular, el muestreo de las s coronas se hace al menos 2s veces.

Mientras que en la dirección radial se usan Wavelets locales.

La fórmula en el dominio de la frecuencia de la Ridgelet está dada por la ecuación 25.

𝜌𝜆

̂(𝜉) =1 2|𝜉|

−12(𝜓 𝑗,𝑘 (

̂ |𝜉|). 𝑤𝑖,𝑙(𝜃) + 𝜓̂ (−|𝜉|). 𝑤𝑗,𝑘 𝑖,𝑙(𝜃 + 𝜋))

30

Donde,

𝑤𝑖,𝑙 Son Wavelets periódicas para [𝜋, 𝜋)

i es la escala angular y 𝑙 ∈ [0, 2𝑖−1− 1] es la localización angular

𝜓𝑗,𝑘 Son las Wavelets Meyer para ℜ

j es la escala ridgelet y k es la localización ridgelet (Devir & Shpinner, 2006)

Estos procedimientos se pueden observar gráficamente en la Figura 11, en la misma se encuentra el análisis a realizar sobre un fragmento de ridge, encontrando los cuadros de importancia, aplicando la transformada de Fourier, posterior se define la cuadricula, se

aplican las ridgilets a cada segmento y se aplica a transformada inversa bajo divisiones angulares.

Figura 11. Análisis ridgelet de un fragmento de ridge (Donoho& Duncan, 2000)

Esto significa entonces que cuando se encuentra un objeto con una transformada de Fourier,

que parece un fragmento de dicha ridge, se puede representar con muy pocos coeficientes. El fragmento ridge se apoya en una banda de resolución angular de 2s, de tal manera que

tiene un orden de 2s coeficientes para representar un fragmento individual, únicamente la

31

Una vez se obtiene los coeficientes Ridgilet se puede realizar una reconstrucción que

también requiere varios pasos los cuales comprenden

La síntesis ridgelet: Cada cuadro es reconstruido desde un sistema ortonormal ridgelet

𝑔𝑄 = ∑ 𝛼 (𝜆, 𝑄) 𝜌𝜆 𝜆

Ecuación 25

Renormalización: Cada cuadro resultante en el paso anterior es renormalizado a su propio cuadro adecuado

ℎ𝑄 = (𝑇𝑄)𝑔𝑄, 𝑄 ∈ ℌ𝑠

Ecuación 26

Integración de bordes: Inversa de la disección de ventanas a cada una de las ventanas

reconstruidas en el paso anterior

∆𝑠𝑓 = ∑ 𝑤𝑄. ℎ𝑄 𝑄∈ ℌ𝑠

Ecuación 27

Recomposición sub banda: Finalmente se deshacen los bancos de filtros de sub banda

P0(P0𝑓) + ∑ ∆𝑠 (∆𝑠𝑓) 𝑠>0

Ecuación 28

5.6. Criterio estadístico de selección

El criterio estadístico matemático está compuesto por la creación de varios índices calculados para evaluar las fusiones y su capacidad de conservar la calidad espectral y

32

Para esta evaluación se aplicaron los estadísticos Entropía, Calidad Universal, Divergencia,

Bias, Coeficiente de correlación, RASE, RMSE, ERGAS, RASE, explicados en el marco teórico; estos algoritmos fueron implementados mediante el código “Hyperspectral Image

Index Analysis” (Vaiopoulos, 2011) .

El índice ERGAS espectral (del francés Erreur Relative Globale Adimensionalle de

Synthèse) (Medina et al., 2013) viene dada por la ecuación 29.

𝑬𝑹𝑮𝑨𝑺𝑬𝒔𝒑𝒆𝒄𝒕𝒓𝒂𝒍= 𝟏𝟎𝟎 𝒉

𝒍√ 𝟏

𝑵𝒃𝒂𝒏𝒅𝒂𝒔 ∑ [

(𝑹𝑴𝑺𝑬𝑬𝒔𝒑𝒆𝒄𝒕𝒓𝒂𝒍(𝑩𝒂𝒏𝒅𝒂𝒊))𝟐

(𝑴𝑼𝑳𝑻𝑰𝒊)𝟐 ]

𝑵𝑩𝒂𝒏𝒅𝒂𝒔

𝒊=𝟏

Ecuación 29

Donde h y l representan la resolución espacial de las imágenes pancromáticas ( PAN ) y

multiespectrales (MULTI ) ; NBands es el número de bandas de la imagen fusionada; MULTI i es el valor de la radiancia e la banda i − ésima de imagen (Wald, 2000) y RMSE

será definida en la ecuación 30 (Medina et al., 2013) .

𝑅𝑀𝑆𝐸𝐸𝑠𝑝𝑒𝑐𝑡𝑟𝑎𝑙 (𝐵𝑎𝑛𝑑𝑎𝑖) = 1

𝑁𝑃√∑ (𝑀𝑈𝐿𝑇𝐼𝑖(𝑗) − 𝐹𝑈𝑆𝑖 (𝑗) ) 2 𝑁𝑃

𝑖=1

Ecuación 30

También existe un ERGAS espacial y su respectivo error el cual evalúa la calidad espacial

de las imágenes y está basado en el anterior.

33 𝑹𝑨𝑺𝑬 = 𝟏𝟎𝟎𝒉 𝒍√ 𝟏 𝑵∑ [ (𝑹𝑴𝑺𝑬(𝑩𝒊)𝟐) 𝑴𝒊𝟐 ] 𝒏 𝒊=𝟏 Ecuación 31

Donde h es la alta resolución espacial (imagen pancromática) y l es la baja resolución espectral (imagen multiespectral) (Wald, 2000) . Los mejores resultados se obtienen

cuanto el porcentaje está más cerca a cero (Medina et al., 2013) .

La calidad universal proporciona un modelo de índice de calidad identifica cualquier distorsión como una combinación de tres factores: pérdida de correlación, distorsión de

luminancia y contraste de distorsión (Medina et al., 2013) . Los mejores valores de este índice se obtienen cuando el valor es más cercano a uno.

𝑸 = 𝝈𝒙𝒚 𝝈𝒙𝝈𝒚 . 𝟐𝒙̅𝒚̅ (𝒙̅)𝟐(𝒚̅)𝟐 . 𝟐𝝈𝒙𝝈𝒚 𝝈𝒙𝟐+ 𝝈 𝒙𝟐 Ecuación 32

Así mismo el coeficiente de correlación, donde la correlación entre las diferentes bandas

de las imágenes fusionadas y las bandas de la imagen original se pueden calcular así:

𝒄𝒐𝒓𝒓 (𝑨/𝑩) = ∑ (𝑨𝒋− 𝑨̅) (𝑩𝒋− 𝑩̅) 𝒏𝒑𝒊𝒙

𝒋=𝟏

√∑𝒏𝒑𝒊𝒙𝒋=𝟏 (𝑨𝒋− 𝑨̅) ∑𝒏𝒑𝒊𝒙𝒋=𝟏 (𝑩𝒋− 𝑩̅)

Ecuación 33

Donde A y B son los valores media de las imágenes correspondientes, corr (A/ B) se llama coeficiente de correlación y varía entre –1 y +1. Se usan los signos + y – para las correlaciones positivas y negativas, respectivamente. Nótese que corr (A/ B) es una

34

BIAS, “el principio básico de la fidelidad espectral es que la información de baja frecuencia

espacial en la imagen de alta resolución no debe ser absorbido a la imagen de fusión, a fin de preservar el contenido espectral de la imagen original de multiresolución” (Morales &

Azuela, 2011) .

Bias de media es la diferencia entre las medias de la imagen original multiespectral y de la

imagen fusionada, su valor se da en relación a la imagen original y el valor ideal debe ser cero (Morales & Azuela, 2011) . Esta dado por la ecuación 30.

𝑩𝑴 = 𝟏 −𝑴𝒆𝒅𝒊𝒂 (𝑰𝒎𝒂𝒈𝒆𝒏 𝒇𝒖𝒔𝒊𝒐𝒏𝒂𝒅𝒂) 𝑴𝒆𝒅𝒊𝒂 (𝑰𝒎𝒂𝒈𝒆𝒏 𝒐𝒓𝒊𝒈𝒊𝒏𝒂𝒍)

Ecuación 34

ENTROPIA, puede mostrar la información de media incluida en la imagen y reflejar la información de detalle de la imagen fusionada; comúnmente la mayor es la entropía de la imagen fusionada, la información más abundante está incluida en ella y mayor será la

calidad de la fusión. A mayor entropía se presentara más desorden en los niveles de gris (Morales & Azuela, 2011) . Esta dada por la ecuación 35.

𝑬 = − ∑ 𝑷𝒊𝐥𝐨𝐠𝟐𝑷𝒊 𝟐𝟓𝟓

𝒊=𝟎

Ecuación 35

DIVERGENCIA: Es la diferencia entre las varianzas de la imagen original y la imagen

fusionada, su valor ideal es 0. Está dada por la ecuación 36.

𝑫𝒊𝒗 = 𝟏 −𝑽𝒂𝒓𝒊𝒂𝒏𝒛𝒂 (𝑰𝒎𝒂𝒈𝒆𝒏 𝒇𝒖𝒔𝒊𝒐𝒏𝒂𝒅𝒂) 𝑽𝒂𝒓𝒊𝒂𝒏𝒛𝒂 (𝑰𝒎𝒂𝒈𝒆𝒏 𝒐𝒓𝒊𝒈𝒊𝒏𝒂𝒍)

35

Se tomó como criterio de decisión el estadístico de calidad Universal (Q), porque este

evalúa la distorsión en tres factores: perdida de correlación, distorsión de luminancia y contraste; y para la aplicación de la MM se busca la menor distorsión posible. En caso de

existir valores iguales o muy cercanos se decide tomar como segundo criterio de decisión el valor del índice de correlación (CC) , porque este permite evaluar la relación de pérdida de

información entre la imagen original y la fusionada.

5.7. Criterio teórico de selección

Este criterio se usó basado en (Medina & Lizarazo, 2004) , donde se determina la elección del nivel de descomposición adecuado, se calcula con la ecuación 37

B

A= k = 2n, donde n ∈ Z

Ecuación 37

El nivel de descomposición adecuado es cercano a 2n

B, equivale a la imagen multiespectral en metros.

A, corresponde a la imagen pancromática en metros.

5.8. Criterio Visual de evaluación

El propósito principal de las imágenes de satélite es describir, evaluar y representar visualmente las características físicas y las actividades en la Tierra. La visualización directa

de los objetos y las clases potenciales de interés llevan al descubrimiento de información a través de análisis e interpretación para diversas tareas (Bratasanu et al., 2012)

36

La cantidad de ganancia de conocimiento es una función de la imagen, del conocimiento a

priori del usuario y las propiedades particulares de las capacidades perceptivas y cognitivas del usuario. El objetivo de métodos de visualización, ya sea por técnicas de procesamiento

de imagen eso mediante la selección de bandas espectrales específicas, es maximizar la respuesta en el sistema visual humano y aumentar la prominencia del objeto / área de interés (Bratasanu et al., 2012) .

Los elementos dentro de una imagen que proporcionan acceso directo a tareas de detección, identificación y medición de análisis avanzado de imágenes incluyen: tono / color, tamaño,

forma, textura, patrón, matiz, sombra y asociación Figura 12 muestra los elementos relacionadas con la que proceso de interpretación de imágenes, como una función de su grado de complejidad (Bratasanu et al., 2012) .

Figura 12. Ordenamiento primario de elementos fundamentales de imagen para proceso de análisis.

Elaboración propia.

El primer paso en todas las tareas de interpretación imagen es para detectar e identificar fenómenos importantes (Bratasanu et al., 2012) .

Una vez se aplican las diferentes transformadas y se realiza la respectiva evaluación con los