Planning en agentes inteligentes

Texto completo

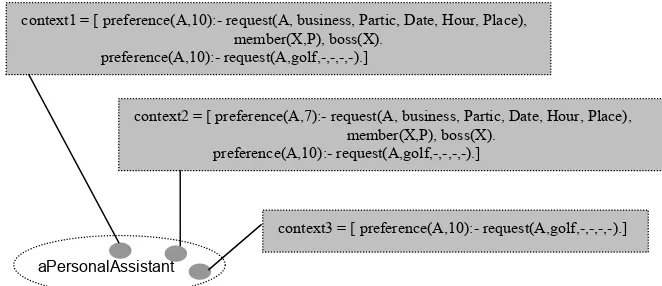

Figure

Documento similar

La metodología de investigación empleada fue del tipo experimental. población en proceso de evaluación judicial). Los sujetos de la muestra en evaluación de custodias

ELABORACIÓN DE LOS MAPAS DE PELIGROSIDAD Y RIESGO REQUERIDOS POR EL R.D...

De este modo se constituye un espacio ontológico y epistemológico a la vez, en el que cada elemento (cada principio) ocupa un lugar determinado en la totalidad, y desde ahí está

Lomo de salmón glaseado al mango y asado al horno de carbón, servido con un topping de pico de gallo y mango fresco, una guarnición de ensalada mézclum y verdura asada de

La combinación, de acuerdo con el SEG, de ambos estudios, validez y fiabilidad (esto es, el estudio de los criterios de realidad en la declaración), verificada la

Respecto a las enfermedades profesionales, en virtud del RD 1299/2006, de 10 de noviembre, por el que se aprueba el cuadro de enfermedades profesionales en el sistema de

Entre los documentos de interés del apartado del FEMP de la web del Departamento, con fecha de 6 de marzo de 2017, se incluyó el “INFORME SOBRE EL SISTEMA DE

Las características del trabajo con grupos que se debería llevar a cabo en los Servicios Sociales de Atención Primaria (SSAP), en términos de variabilidad o estabilidad